Блог

Практические материалы об архитектуре LLM-приложений, маршрутизации моделей, оптимизации затрат и продакшен-эксплуатации AI-систем.

Свежие материалы

14 июн. 2025 г.·9 мин чтения

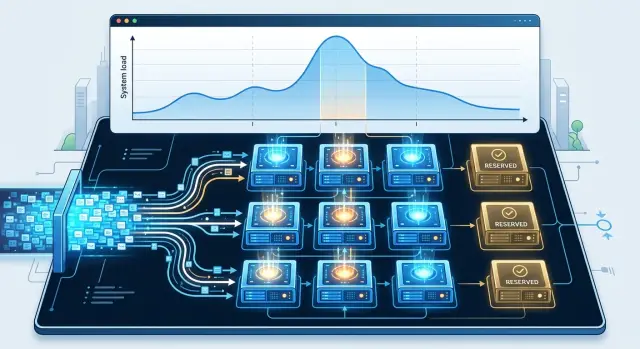

Тёплый пул моделей: как рассчитать запас на пиковые часы

Тёплый пул моделей помогает пройти пиковые часы без лишних затрат. Покажем, как считать запас GPU, смотреть на очередь и не держать пустые мощности.

тёплый пул моделейпиковая нагрузка LLM

07 июн. 2025 г.·10 мин чтения

Извлечение таблиц из PDF: как собрать чистые данные

Извлечение таблиц из PDF требует не только парсинга, но и нормализации строк, проверки сумм и ручного контроля спорных мест.

извлечение таблиц из PDFпарсинг PDF таблиц

05 июн. 2025 г.·7 мин чтения

Когда маленькая модель лучше большой в рабочих задачах

Разбираем, когда маленькая модель лучше большой: классификация, извлечение полей, цена, задержка, ошибки и простой способ выбора.

маленькая модель лучше большойклассификация текстов LLM

04 июн. 2025 г.·7 мин чтения

Критерии оценки ассистента поддержки для ручной проверки

Разберем, как задать критерии оценки ассистента поддержки для ручной проверки: точность, тон, полезность и безопасность без лишней сложности.

критерии оценки ассистента поддержкиручная проверка ответов ИИ

03 июн. 2025 г.·11 мин чтения

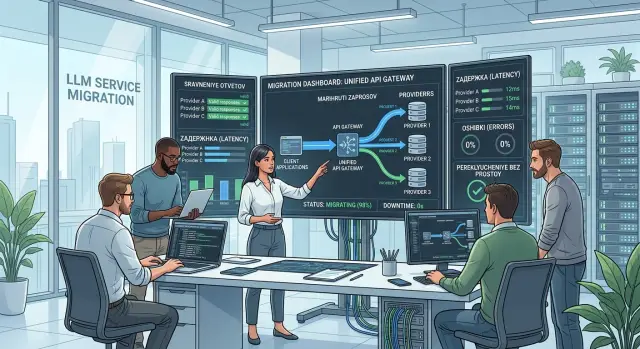

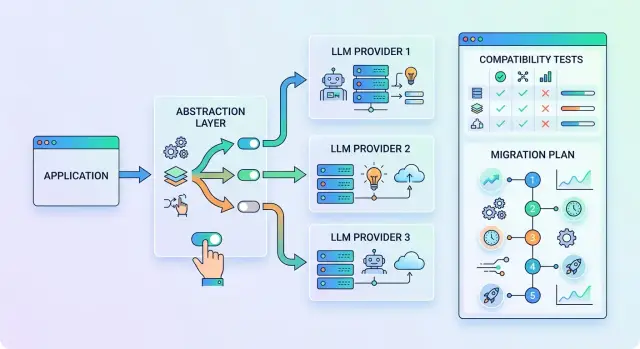

Миграция на несколько AI-провайдеров без остановки сервиса

Миграция на несколько AI-провайдеров без остановки сервиса: этапы, проверка совместимости SDK, теневой запуск и сравнение ответов до переключения.

миграция на несколько AI-провайдеровсовместимость OpenAI SDK

27 мая 2025 г.·11 мин чтения

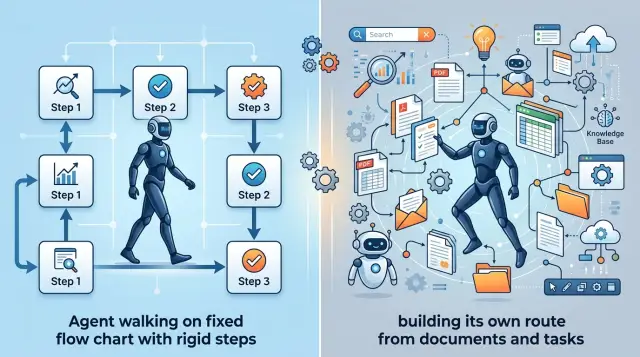

Агент с планированием или по сценарию: как выбрать

Разбираем, когда агент с планированием или по сценарию лучше подходит для поддержки, поиска и внутренней автоматизации, без лишней теории.

агент с планированием или по сценариюLLM агент для поддержки

24 мая 2025 г.·10 мин чтения

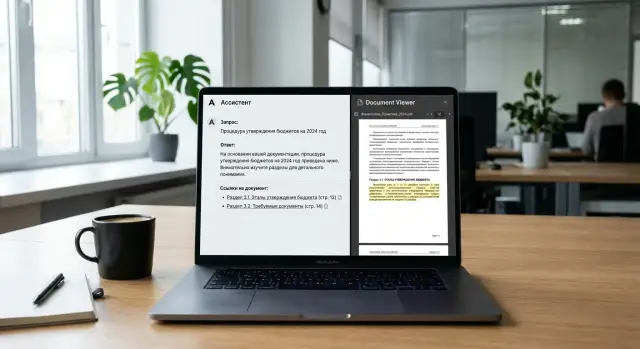

Ссылки на источники в ответе ассистента: как их строить

Ссылки на источники в ответе ассистента помогают проверить выводы. Разберем, как собирать цитаты по документу, а не по случайным кускам текста.

ссылки на источники в ответе ассистентацитаты по документу

23 мая 2025 г.·6 мин чтения

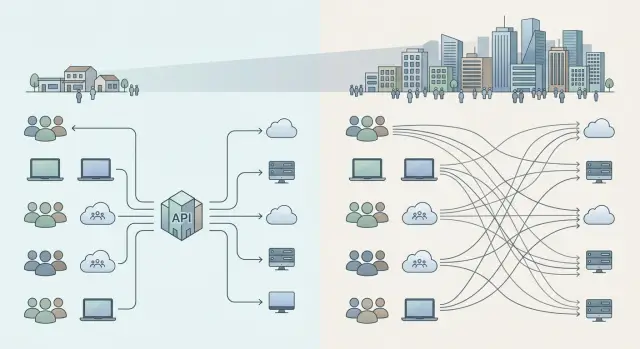

Единый API для LLM: когда он лучше отдельных интеграций

Единый API для LLM помогает сравнить общий шлюз и отдельные интеграции по затратам, скорости запуска, контролю доступа и росту команд.

единый API для LLMцентрализованная платформа ИИ

23 мая 2025 г.·6 мин чтения

Отмена стриминга LLM: как не платить за лишние токены

Отмена стриминга LLM помогает остановить лишние токены, когда пользователь ушёл со страницы. Разберём сигналы, таймауты, логи и проверки.

отмена стриминга LLMлишние токены

23 мая 2025 г.·7 мин чтения

Метрики LLM-шлюза в продакшене: короткий набор на день

Метрики LLM-шлюза помогают каждый день видеть качество, задержку, ошибки и расходы. Разберем короткий набор цифр для решений в продакшене.

метрики LLM-шлюзамониторинг LLM в продакшене

22 мая 2025 г.·8 мин чтения

Runbook для дежурного по LLM-сервису на первые 15 минут

Короткий Runbook для дежурного по LLM-сервису: как за 15 минут проверить рост ошибок, цены и задержки, расставить приоритеты и не сорвать сервис.

Runbook для дежурного по LLM-сервисучек-лист инцидента LLM

16 мая 2025 г.·11 мин чтения

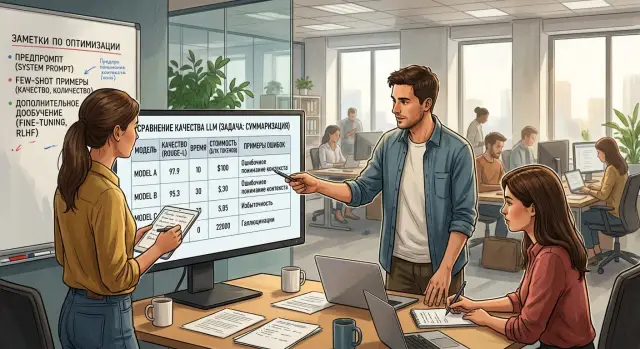

Когда не нужно дообучение: данные, промпт или роутинг

Когда не нужно дообучение: разберём признаки, что задачу лучше закрывают чистые данные, сильный промпт, eval и роутинг моделей.

когда не нужно дообучениепромпт вместо дообучения

14 мая 2025 г.·8 мин чтения

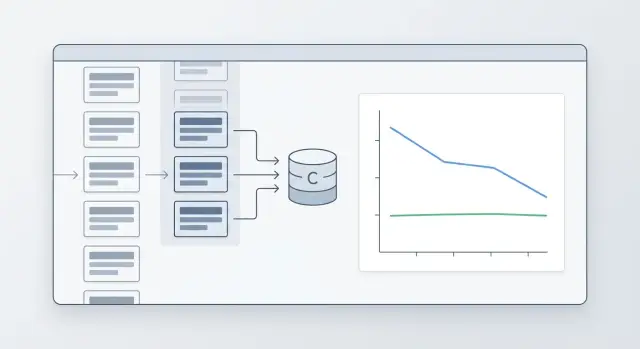

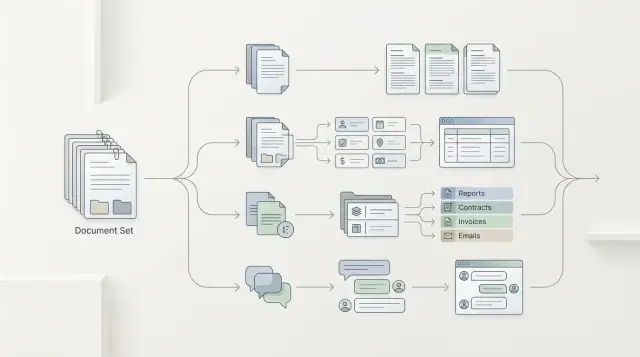

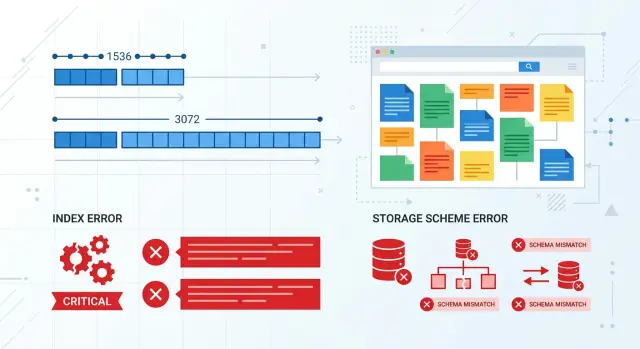

Эволюция схемы извлечённых данных без хаоса в аналитике

Эволюция схемы извлечённых данных без хаоса в аналитике: как менять поля, словари и версии так, чтобы старые отчёты не ломались и цифры не расходились.

эволюция схемы извлечённых данныхверсионирование схемы

08 мая 2025 г.·8 мин чтения

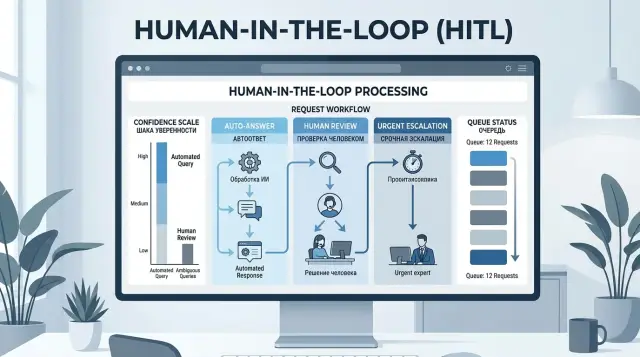

Человек в контуре: пороги уверенности без ручного ада

Человек в контуре нужен не для каждой проверки: разберите пороги уверенности, типы запросов и простой порядок эскалации к оператору.

человек в контурепороги уверенности LLM

07 мая 2025 г.·11 мин чтения

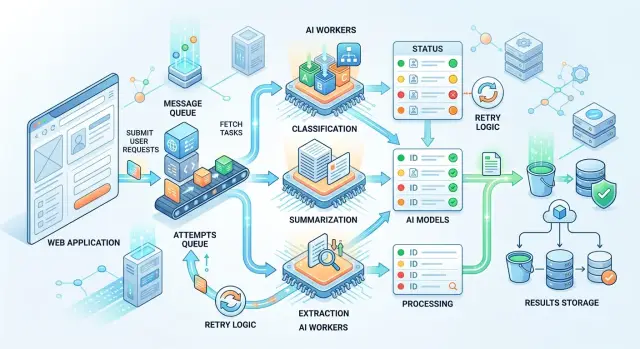

AI-задачи через очередь: когда уводить в async-пайплайн

Разберем, когда AI-задачи через очередь работают лучше веб-запроса, как собрать async-пайплайн и где он снижает таймауты, цену и риск сбоев.

AI-задачи через очередьasync-пайплайн для LLM

07 мая 2025 г.·6 мин чтения

Admission control для длинных промптов в LLM-сервисе

Admission control для длинных промптов помогает держать LLM-сервис доступным под нагрузкой. Разберем приоритеты, усечение, отказы и быстрые проверки.

Admission control для длинных промптовочереди запросов LLM

05 мая 2025 г.·9 мин чтения

Кэш промптов: когда он реально снижает счёт за LLM

Кэш промптов помогает не всегда. Разберём пороги повторяемости запросов, формулу экономии, риски для качества и быстрый способ проверки.

кэш промптовповторяемость запросов LLM

29 апр. 2025 г.·9 мин чтения

Пиковая нагрузка на LLM-функции: как не уронить продукт

Пиковая нагрузка на LLM-функции не должна валить продукт. Разберём, когда включать очереди, упрощать ответы и переводить трафик на лёгкие модели.

пиковая нагрузка на LLM-функцииочереди запросов LLM

27 апр. 2025 г.·8 мин чтения

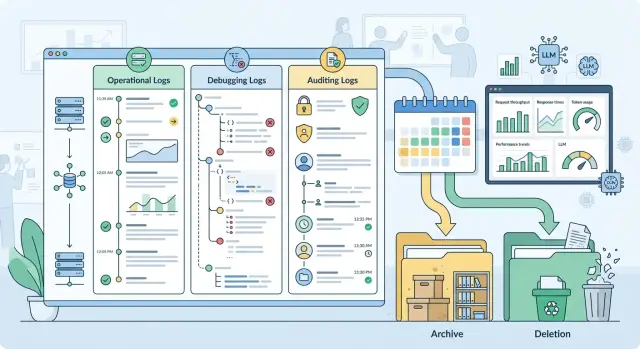

Сроки хранения логов LLM: как разделить записи по классам

Разберем сроки хранения логов LLM: как разделить операционные, отладочные и аудиторские записи и не копить лишние данные.

сроки хранения логов LLMаудит логов LLM

25 апр. 2025 г.·8 мин чтения

Системный промпт или короткие правила: как снизить дрейф

Системный промпт или короткие правила: когда выбрать один длинный блок, а когда - модульный набор, чтобы снизить дрейф и упростить ревью.

системный промпт или короткие правиладрейф инструкций

25 апр. 2025 г.·8 мин чтения

Корпоративный пилот LLM: с чего начать и как не затянуть

Корпоративный пилот LLM проще начать с одной боли бизнеса, короткого плана на 4 недели, базовой проверки данных и понятных метрик результата.

корпоративный пилот LLMзапуск LLM в компании

16 апр. 2025 г.·10 мин чтения

Когда боту нужно передать диалог оператору без споров

Разбираем, когда боту стоит передать диалог оператору: сигналы риска, эмоции клиента, неуверенность ответа, ошибки настройки и короткая проверка.

передать диалог операторуэскалация чат-бота

13 апр. 2025 г.·11 мин чтения

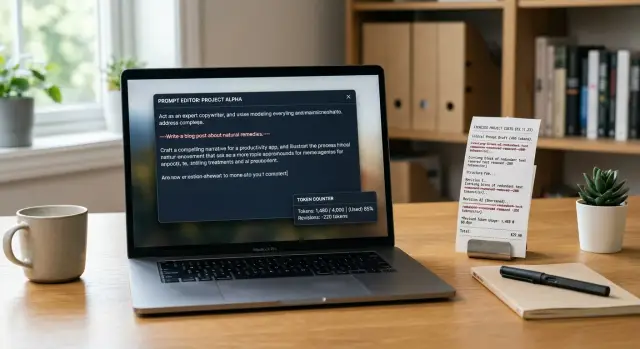

Ошибки в промптах: 5 причин раздутого счёта за LLM

Разбираем, как лишние инструкции, повторы и длинный контекст увеличивают расход токенов, и как убрать ошибки в промптах без потери качества.

ошибки в промптахстоимость запросов LLM

13 апр. 2025 г.·6 мин чтения

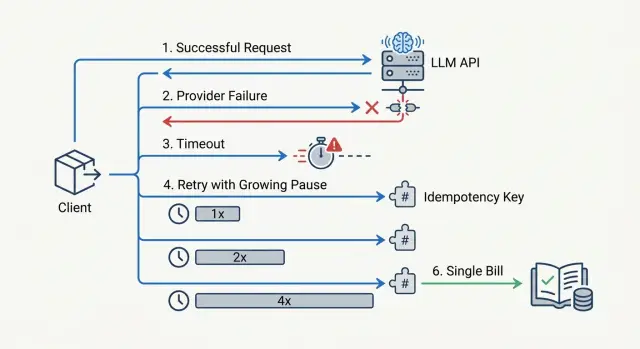

Ретраи для LLM API: как не удвоить счёт при сбоях

Ретраи для LLM API помогают пережить сбои, но без лимитов и идемпотентности они быстро раздувают затраты. Разберём таймауты, паузы и проверки.

ретраи для LLM APIидемпотентность запросов

12 апр. 2025 г.·11 мин чтения

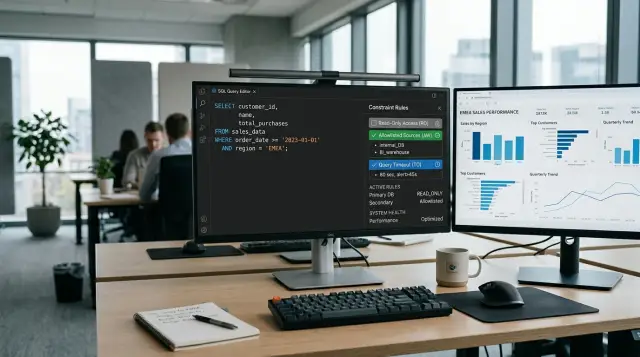

SQL-агент без риска для продакшен-базы: readonly и лимиты

SQL-агент без риска для продакшен-базы: как настроить readonly, allowlist запросов, таймауты и быстрые проверки перед запуском.

SQL-агент без риска для продакшен-базыreadonly доступ к базе

06 апр. 2025 г.·6 мин чтения

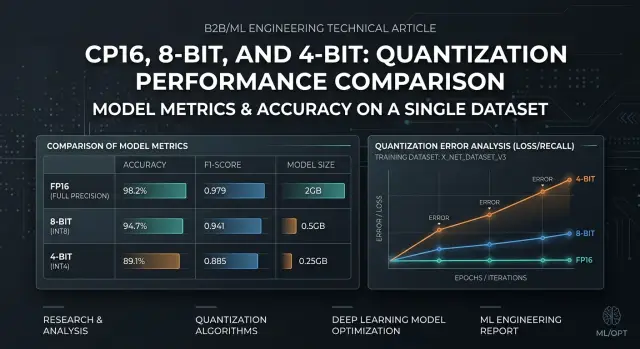

Квантизация модели: проверки перед переходом на 8-bit и 4-bit

Квантизация модели требует проверки качества на вашем наборе: выберите метрики, найдите сбои и сравните FP16, 8-bit и 4-bit до релиза.

квантизация моделиFP16 vs 8-bit

06 апр. 2025 г.·7 мин чтения

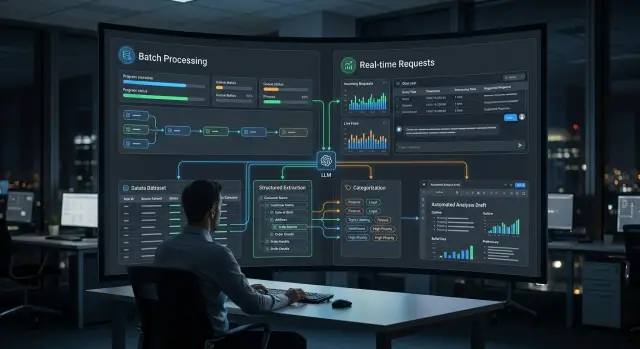

Пакетный инференс или онлайн вызовы для ночных задач

Пакетный инференс подходит для ночной обработки, но не всегда выигрывает у онлайн вызовов. Разберём извлечение, категории и черновики.

пакетный инференсонлайн вызовы LLM

06 апр. 2025 г.·11 мин чтения

Валидация ответа перед записью в CRM и ERP без сбоев

Валидация ответа помогает поймать сломанную схему, неверные числа и битые ссылки до записи в CRM или ERP и снизить число ручных правок.

валидация ответапроверка схемы

04 апр. 2025 г.·11 мин чтения

RAG или длинный контекст: как выбрать схему для поиска

RAG или длинный контекст: разберём, как эти подходы влияют на поиск по документам, цену и задержку, чтобы выбрать схему под ваш продукт.

RAG или длинный контекстпоиск по документам

31 мар. 2025 г.·9 мин чтения

Отчёт по расходам на LLM для бухгалтерии и CTO без ручных сверок

Отчёт по расходам на LLM помогает свести токены, модели и команды в один формат, чтобы бухгалтерия и CTO сверяли цифры без ручной работы.

отчёт по расходам на LLMучёт токенов LLM

29 мар. 2025 г.·6 мин чтения

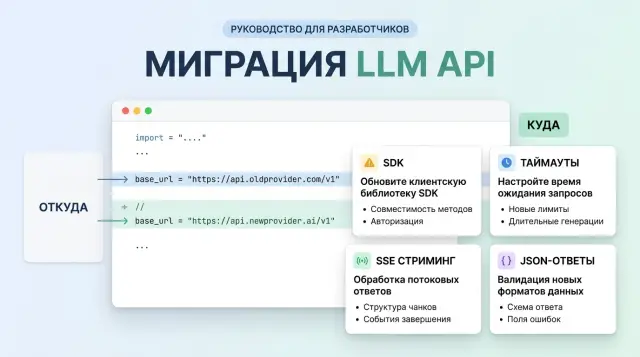

Миграция на OpenAI-совместимый эндпоинт без сюрпризов

Миграция на OpenAI-совместимый эндпоинт кажется простой заменой base_url, но часто ломается на SDK, таймаутах, стриминге и JSON-ответах.

миграция на OpenAI-совместимый эндпоинтзамена base_url OpenAI

24 мар. 2025 г.·8 мин чтения

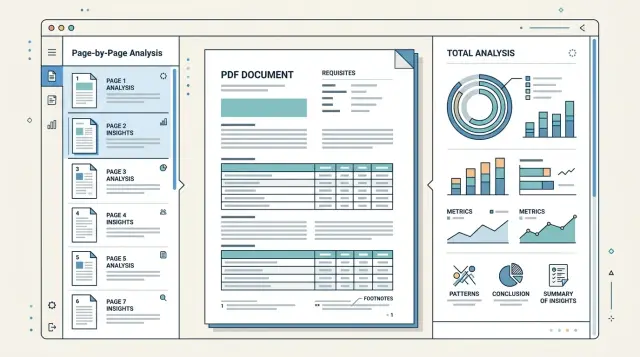

Проверка PDF по страницам или целиком: что выбрать

Проверка PDF по страницам подходит для длинных файлов с разным шаблоном, а полный разбор удобен для стабильных документов и сводных полей.

проверка PDF по страницамизвлечение реквизитов из PDF

23 мар. 2025 г.·6 мин чтения

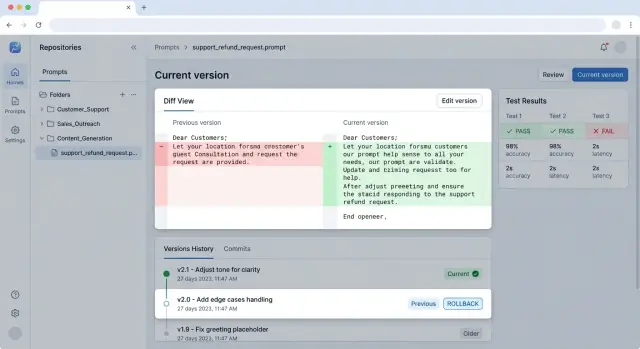

Версионирование промптов для релизов без сюрпризов

Версионирование промптов помогает выпускать изменения без сбоев: разберем структуру репозитория, тесты, откат и рабочий процесс команды.

версионирование промптоврепозиторий промптов

15 мар. 2025 г.·8 мин чтения

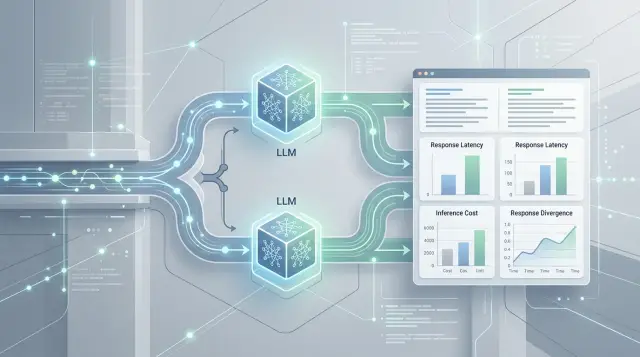

Теневой трафик для смены модели без сбоев и сюрпризов

Теневой трафик для смены модели помогает сравнить ответы, задержку и цену до релиза. Покажем, как считать расхождения и переключаться спокойно.

теневой трафик для смены моделипараллельные запросы LLM

11 мар. 2025 г.·7 мин чтения

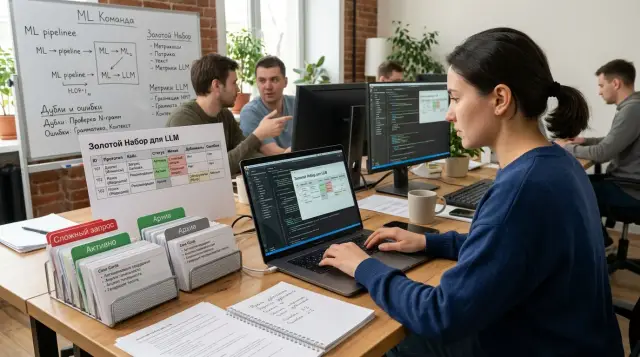

Золотой набор для LLM: как поддерживать его без свалки

Золотой набор для LLM помогает проверять качество без хаоса: как отбирать кейсы, архивировать старые примеры и сохранять редкие сложные запросы.

золотой набор для LLMоценка качества LLM

10 мар. 2025 г.·9 мин чтения

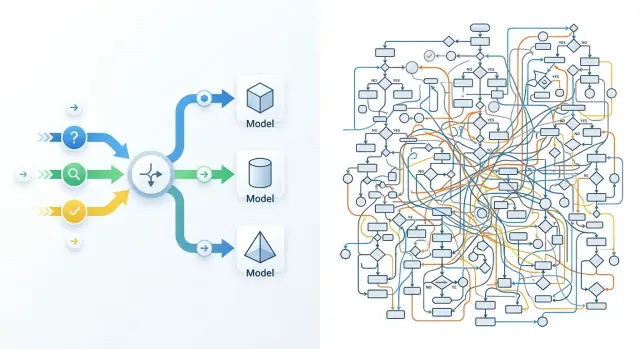

Роутинг моделей: почему первая схема не окупается

Роутинг моделей часто не даёт отдачи с первой попытки: команды рано вводят сложные правила. Покажем, как начать с малого набора сигналов.

роутинг моделеймаршрутизация запросов LLM

09 мар. 2025 г.·8 мин чтения

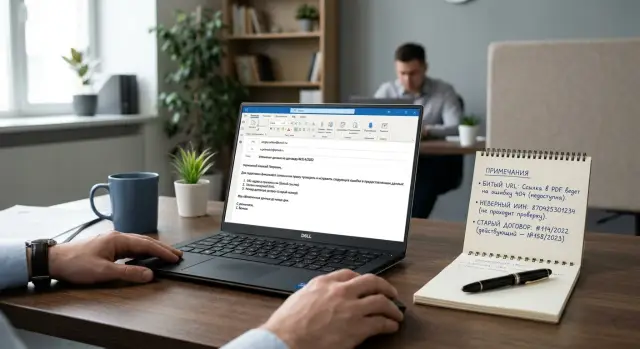

Проверка ссылок и реквизитов после генерации письма

Проверка ссылок и реквизитов после генерации письма помогает поймать битые URL, ошибки в ИИН и старые номера договоров до отправки клиенту.

проверка ссылок и реквизитов после генерации письмабитые URL в письмах

05 мар. 2025 г.·6 мин чтения

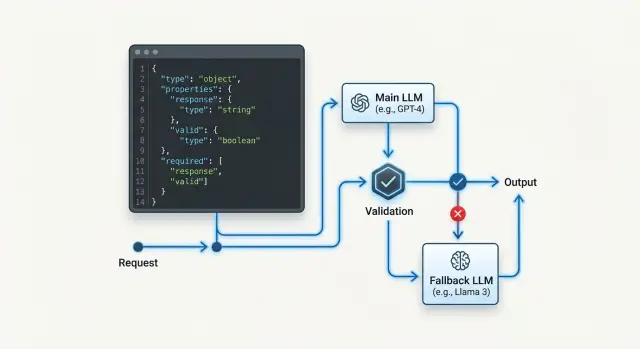

Фолбэк JSON-схемы: как менять модели и не ломать tool-режим

Фолбэк JSON-схемы нужен, когда запасная модель меняет поля, типы или формат ответа. Разберем выбор резервных моделей, валидаторов и проверок.

фолбэк JSON-схемырезервные модели LLM

28 февр. 2025 г.·9 мин чтения

Синтетические примеры для проверки LLM до продакшена

Синтетические примеры для проверки LLM помогают собрать тестовые кейсы, когда реальных данных мало. Разберем шаблоны, ошибки и быстрые проверки.

синтетические примеры для проверки LLMтестовые кейсы для LLM

26 февр. 2025 г.·8 мин чтения

Онлайн и офлайн оценка качества: когда чему верить

Онлайн и офлайн оценка качества помогают ответить на разные вопросы: клики и конверсии ловят эффект в проде, а разметка и ревью находят ошибки раньше.

онлайн и офлайн оценка качестваклики и конверсии

23 февр. 2025 г.·11 мин чтения

Анонимизация договоров и медкарт перед LLM без потери смысла

Анонимизация договоров и медкарт перед LLM требует точных правил: какие поля скрывать, что оставлять и как не исказить юридический или клинический смысл.

анонимизация договоров и медкартчувствительные поля в документах

16 февр. 2025 г.·6 мин чтения

Роутинг LLM для продакшена: как выбрать стратегию

Роутинг LLM для продакшена стоит выбирать по одному набору задач, с метриками цены, задержки и качества, а не по общим тестам.

роутинг LLM для продакшенамаршрутизация моделей

05 февр. 2025 г.·10 мин чтения

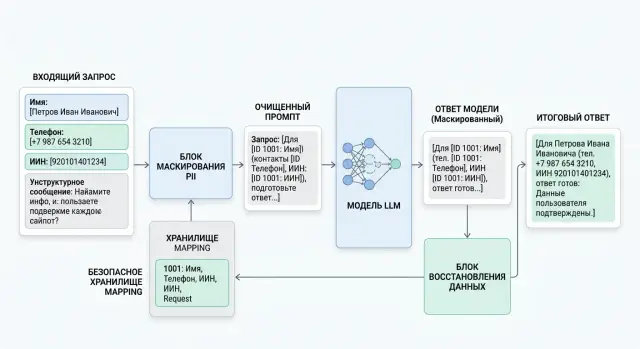

Маскирование PII перед вызовом модели: где и как делать

Маскирование PII помогает скрыть личные данные до запроса к LLM. Покажем, где ставить редактирование, как мерить потерю смысла и как безопасно вернуть поля.

маскирование PIIредактирование персональных данных

05 февр. 2025 г.·6 мин чтения

Когда останавливать AI-агента в финансах, медицине, праве

Когда останавливать AI-агента: разберем признаки риска в финансах, медицине и праве и покажем, где агент должен передать задачу человеку.

когда останавливать AI-агентапередача человеку

27 янв. 2025 г.·10 мин чтения

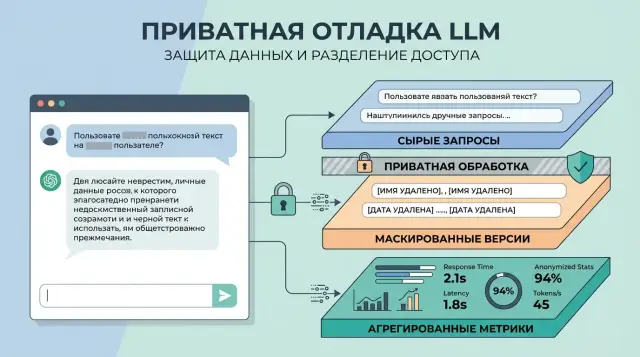

Что хранить для отладки промптов без риска для приватности

Что хранить для отладки промптов: разберем, как разделить сырые запросы, маскированные копии и метрики, чтобы не раскрывать личные данные.

что хранить для отладки промптовмаскирование данных в LLM

27 янв. 2025 г.·10 мин чтения

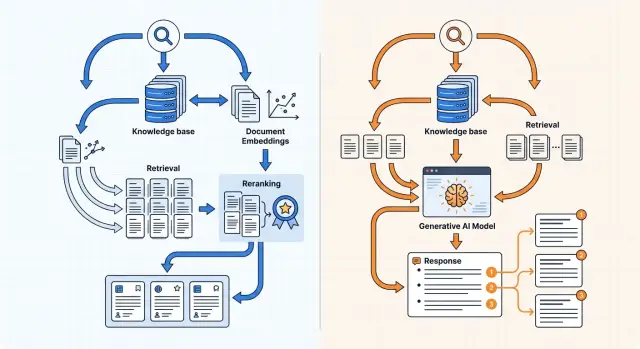

Поиск по базе знаний: эмбеддинги или генеративная модель

Поиск по базе знаний можно строить через эмбеддинги или через генеративную модель. Разберем индексацию, реранжирование и ответы с цитатами.

поиск по базе знанийэмбеддинги

27 янв. 2025 г.·11 мин чтения

Бюджет на LLM для нескольких команд: как посчитать

Покажем, как разложить бюджет на LLM по командам, лимитам и сценариям, чтобы расходы не выросли после пилота и перехода в продакшен.

бюджет на LLMрасходы на LLM

27 янв. 2025 г.·9 мин чтения

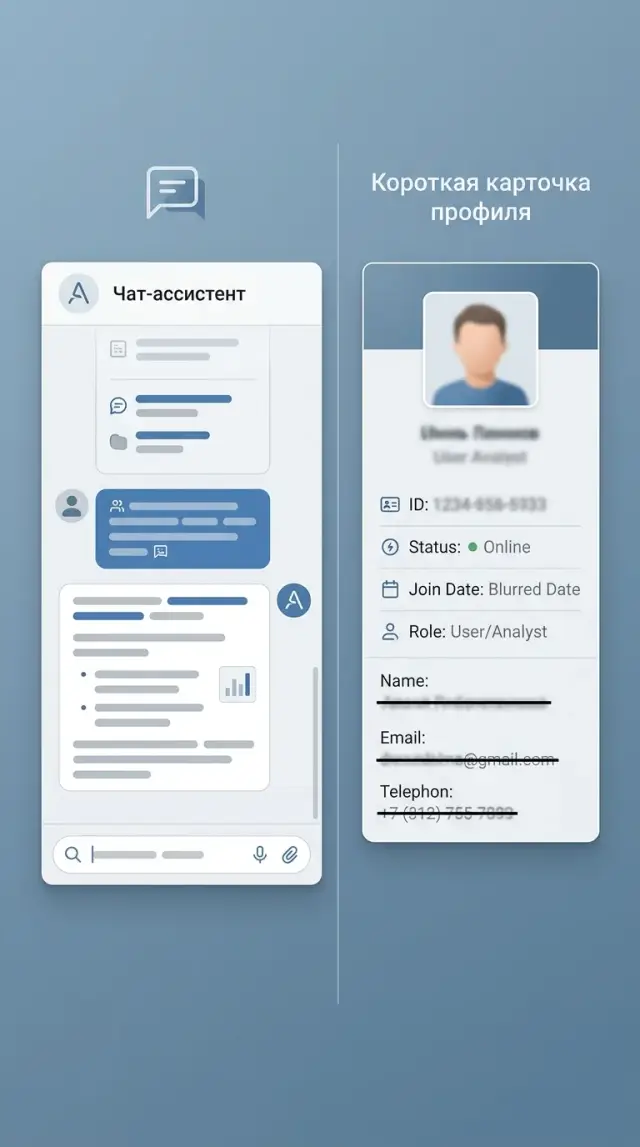

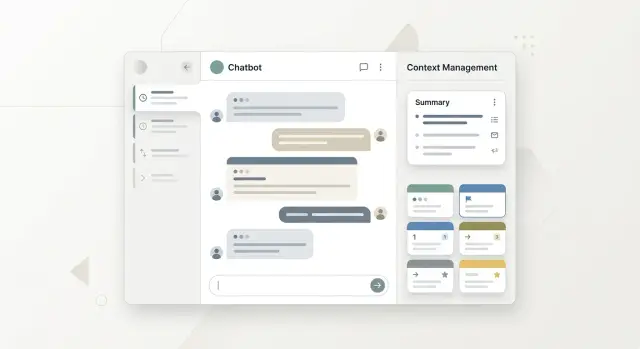

Персонализация ассистента без лишнего профиля и риска

Персонализация ассистента работает лучше, если хранить только признаки, которые меняют ответ: роль, язык, цель запроса и свежий контекст.

персонализация ассистентаминимизация данных

26 янв. 2025 г.·9 мин чтения

Прогноз расхода токенов: как заметить перерасход вовремя

Прогноз расхода токенов помогает заранее увидеть перерасход, поставить пороги, поймать скачки по моделям и не ждать счёта в конце месяца.

прогноз расхода токенованомалии в расходе LLM

25 янв. 2025 г.·11 мин чтения

SLO для LLM-приложений: как считать по целям бизнеса

SLO для LLM-приложений помогают связать задержку, долю валидных ответов и цену с ожиданиями бизнеса, а не с графиками ради отчета.

SLO для LLM-приложенийзадержка и качество LLM

23 янв. 2025 г.·10 мин чтения

Суммаризация диалогов контакт-центра без лишнего шума

Суммаризация диалогов контакт-центра приносит пользу, если карточка звонка показывает тему, итог, риск и следующий шаг без лишних полей.

суммаризация диалогов контакт-центракарточка звонка для супервизора

18 янв. 2025 г.·9 мин чтения

Проверка фактов по источнику: как собрать набор тестов

Проверка фактов по источнику помогает собрать тесты, где ответ сверяют с документом, таблицей или БД. Разберем схему набора, частые ошибки и чек-лист.

проверка фактов по источникуавтоматический набор тестов

16 янв. 2025 г.·6 мин чтения

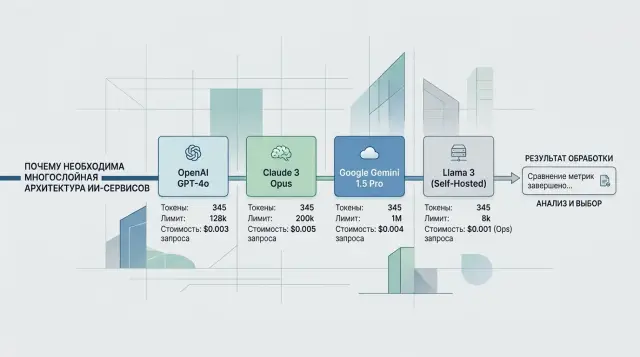

Оценка моделей на своих данных для задач продукта

Оценка моделей на своих данных помогает выбрать LLM под задачи продукта: как собрать сценарии, эталоны, метрики и честно сравнить ответы.

оценка моделей на своих данныхсценарии пользовательских задач

13 янв. 2025 г.·6 мин чтения

Красная команда для корпоративного бота перед запуском

Красная команда для корпоративного бота помогает найти утечки данных, обход инструкций и токсичные ответы до релиза и исправить их по шагам.

красная команда для корпоративного ботаатаки на утечки данных в LLM

30 дек. 2024 г.·9 мин чтения

Удаление данных у провайдера: что запросить до закупки

Удаление данных у провайдера нельзя проверять на словах. До закупки запросите договорные пункты, логи, сроки очистки и порядок аудита.

удаление данных у провайдерапроверка хранения данных

25 дек. 2024 г.·7 мин чтения

Когда дообучение оправдывает затраты, а промпт уже нет

Когда дообучение оправдывает затраты: разберём признаки потолка у промптов, типы задач, расчёт окупаемости и частые ошибки перед запуском.

когда дообучение оправдывает затратыкогда промпт упирается в потолок

24 дек. 2024 г.·7 мин чтения

Проверка кредитных и юридических документов с ИИ

Проверка кредитных и юридических документов с ИИ помогает быстрее находить рискованные места, но итоговый вывод по делу все равно делает специалист.

проверка кредитных и юридических документовИИ для проверки договоров

24 дек. 2024 г.·7 мин чтения

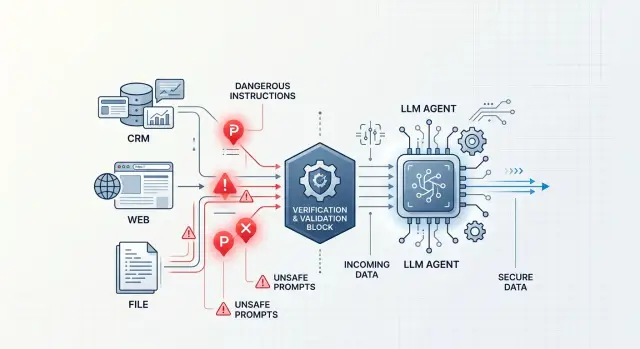

Инъекции через вывод инструмента: как защитить агента

Инъекции через вывод инструмента часто прячутся в CRM, письмах и HTML. Разберём, как фильтровать данные, изолировать инструменты и ставить проверки.

инъекции через вывод инструментазащита LLM-агента

15 дек. 2024 г.·10 мин чтения

Разные токенизаторы у провайдеров: почему цифры не сходятся

Разные токенизаторы у провайдеров меняют цену, лимиты и реальную длину контекста. Разберем, где расходятся расчеты и как это проверить заранее.

разные токенизаторы у провайдеровподсчет токенов LLM

09 дек. 2024 г.·9 мин чтения

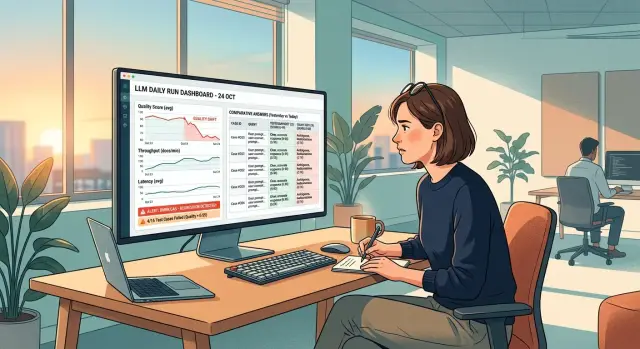

Регрессии LLM: как заметить скрытый сдвиг до жалоб

Регрессии LLM не всегда видны сразу: разберем ежедневные прогоны, тревоги, контрольные кейсы и порядок проверки до жалоб пользователей.

Регрессии LLMконтрольные кейсы для LLM

08 дек. 2024 г.·6 мин чтения

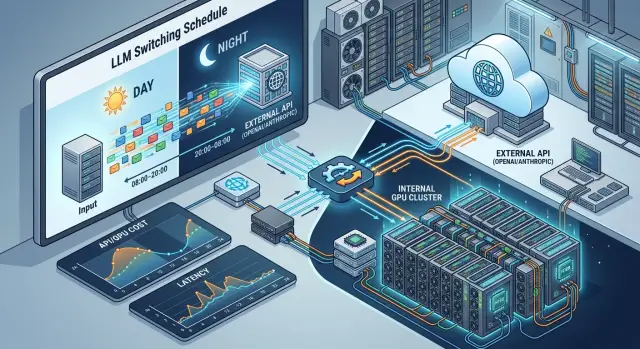

Переключение между hosted и self-hosted моделью по расписанию

Переключение между hosted и self-hosted моделью помогает снизить затраты и задержку, если разделить сценарии по времени суток, данным и пикам нагрузки.

переключение между hosted и self-hosted модельювнешний LLM API

04 дек. 2024 г.·8 мин чтения

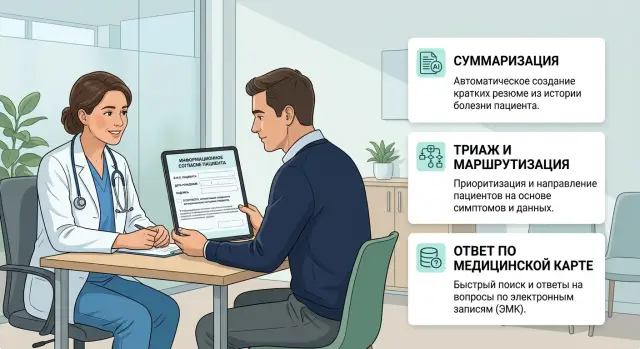

Согласие пациента для LLM в клинике: что фиксировать

Разбираем, как оформить согласие пациента для LLM в клинике: какие точки фиксировать до суммаризации, триажа и ответов по карте.

согласие пациента для LLM в клиникетриаж в клинике

03 дек. 2024 г.·8 мин чтения

Нормализация кодов ошибок LLM API для продукта и поддержки

Нормализация кодов ошибок LLM API помогает свести таймауты, лимиты и bad request в один словарь для продукта, логов и поддержки.

нормализация кодов ошибок LLM APIединый словарь ошибок

02 дек. 2024 г.·11 мин чтения

Цепочка моделей или одна сильная модель: где что лучше

Разбираем, когда цепочка моделей или одна сильная модель дают лучший результат: сравним цену, задержку, качество и риск лишней сложности.

цепочка моделей или одна сильная модельпайплайн LLM

28 нояб. 2024 г.·7 мин чтения

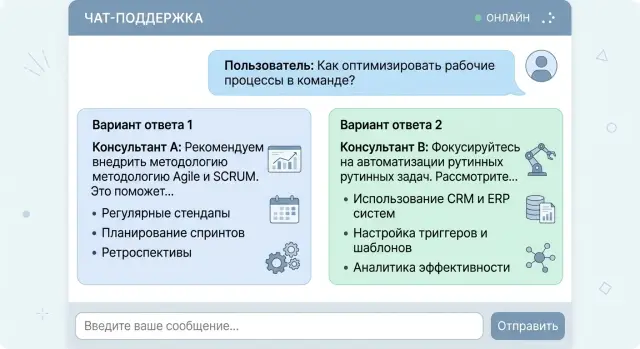

Два ответа на один запрос: когда выбор лучше одного

Разбираем, когда два ответа на один запрос помогают пользователю выбрать тон, формат или действие быстрее, а когда такой подход только путает.

два ответа на один запросальтернативы в ответах ИИ

26 нояб. 2024 г.·6 мин чтения

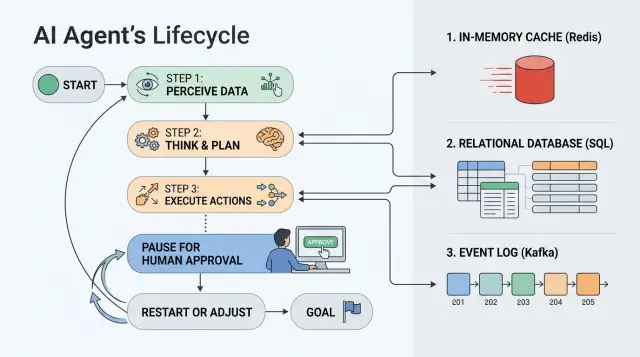

Хранение состояния AI-агента: Redis, БД или журнал

Хранение состояния AI-агента влияет на паузы, одобрение и повторный запуск. Разбираем, когда выбрать Redis, БД или событийный журнал.

хранение состояния AI-агентаRedis для задач с паузами

22 нояб. 2024 г.·10 мин чтения

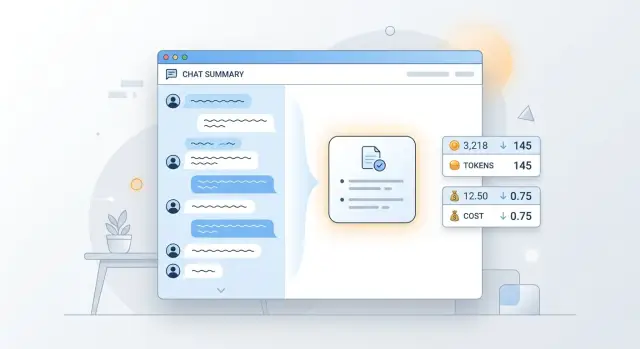

Как не переплачивать за длинный контекст: что резать и что помнить

Как не переплачивать за длинный контекст: разберем обрезку истории, сжатие и выбор памяти диалога, чтобы сохранить смысл и снизить токены.

как не переплачивать за длинный контекстсжатие контекста

15 нояб. 2024 г.·6 мин чтения

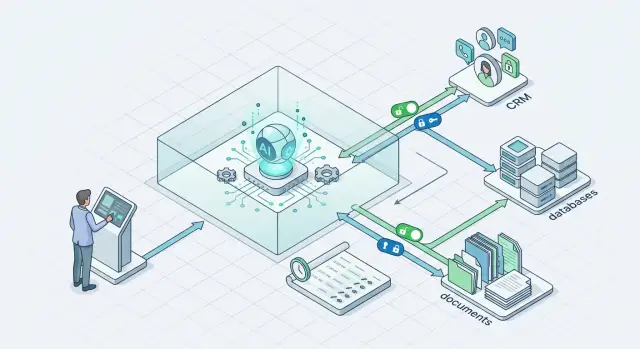

Песочница для AI-инструментов: запись без лишних прав

Песочница для AI-инструментов помогает изолировать запись в CRM, БД и документы, чтобы агент менял только нужные поля и не получал лишний доступ.

песочница для AI-инструментовправа на запись для AI-агента

08 нояб. 2024 г.·11 мин чтения

Скачок токенов: как найти причину до счёта после релиза

После релиза скачок токенов легко пропустить. Разберём, как проверить длину промпта, частоту вызовов, ретраи и странные сценарии до счёта.

скачок токеновдлина промпта

02 нояб. 2024 г.·6 мин чтения

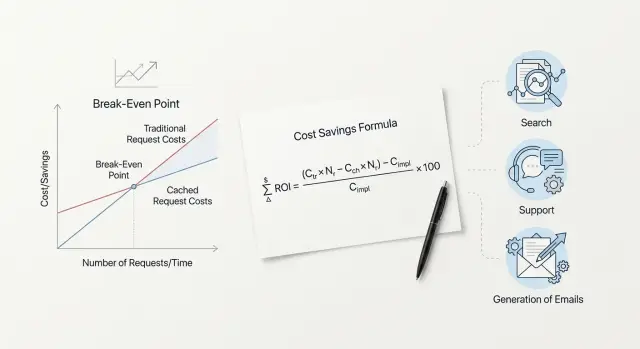

Окупаемость кэша запросов: формула и примеры расчета

Окупаемость кэша запросов легко посчитать по простой формуле. Покажем порог повторов для поиска, поддержки и генерации писем.

окупаемость кэша запросовформула кэширования запросов

02 нояб. 2024 г.·9 мин чтения

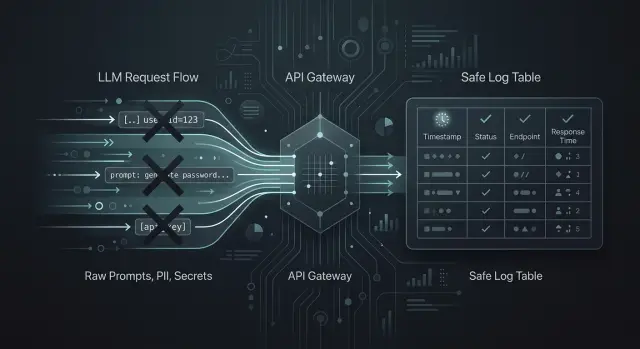

Что логировать в LLM-приложении без лишнего риска

Разберём, что логировать в LLM-приложении, чтобы видеть сбои, ловить инциденты и проходить аудит без хранения промптов, PII и лишних данных.

что логировать в LLM-приложенииминимальный состав логов LLM

31 окт. 2024 г.·11 мин чтения

Когда реранкер окупается: recall, задержка и цена

Разберём, когда реранкер окупается в поиске: как считать прирост recall, влияние на задержку, цену запроса и где лишний шаг не нужен.

когда реранкер окупаетсяреранкер в поиске

30 окт. 2024 г.·10 мин чтения

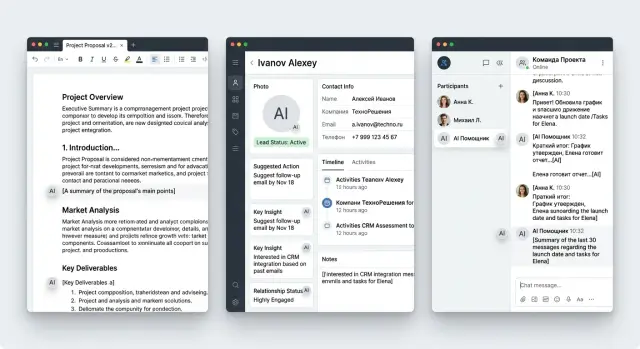

Маркировка AI-контента в интерфейсе: редактор, CRM, чат

Показываем, как работает маркировка AI-контента в интерфейсе и где ставить метку в редакторе, CRM и чате, чтобы она помогала, а не мешала.

маркировка AI-контента в интерфейсеметка AI в редакторе

11 окт. 2024 г.·10 мин чтения

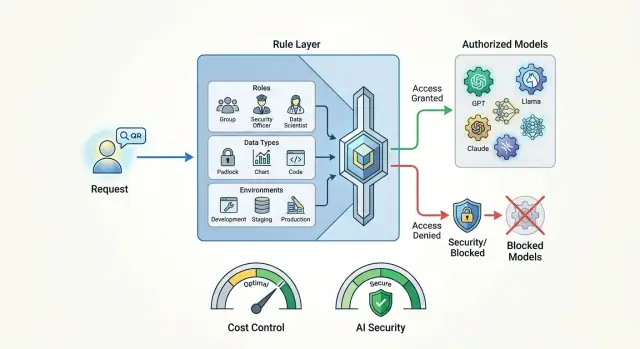

Политики доступа к моделям на один запрос без лишних рисков

Политики доступа к моделям помогают задать правила по ролям, данным и средам, чтобы сдержать расходы и не выпускать чувствительные данные наружу.

политики доступа к моделямограничение дорогих моделей

07 окт. 2024 г.·7 мин чтения

Дедупликация повторных запросов в чатах и формах без вреда для UX

Дедупликация повторных запросов помогает убрать двойные отправки из чатов и форм, сохранить UX и не терять данные при сбоях сети и очередей.

дедупликация повторных запросовдвойные отправки форм

06 окт. 2024 г.·10 мин чтения

Классификация жалоб клиентов: как сочетать правила и LLM

Классификация жалоб клиентов помогает быстрее назначать очередь и SLA, если соединить простые правила, LLM, проверку уверенности и ручной разбор.

классификация жалоб клиентовмаршрутизация обращений

26 сент. 2024 г.·11 мин чтения

Нагрузочное тестирование LLM-сервиса: пик, очереди, узкие места

Нагрузочное тестирование LLM-сервиса помогает понять, где растут очереди, что ломает пик и как найти узкое место в API, сети и ретраях.

нагрузочное тестирование LLM-сервисаочереди в LLM API

23 сент. 2024 г.·9 мин чтения

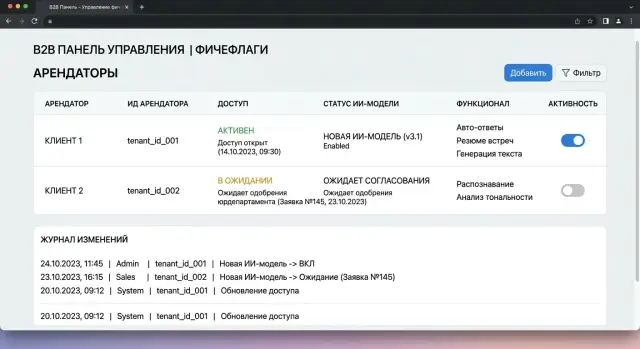

Фичефлаги для AI-функций по арендаторам: схема запуска

Фичефлаги для AI-функций помогают включать новые модели по арендаторам без общего релиза: схема запуска, проверки, ошибки и пример.

Фичефлаги для AI-функцийзапуск моделей по арендаторам

17 сент. 2024 г.·8 мин чтения

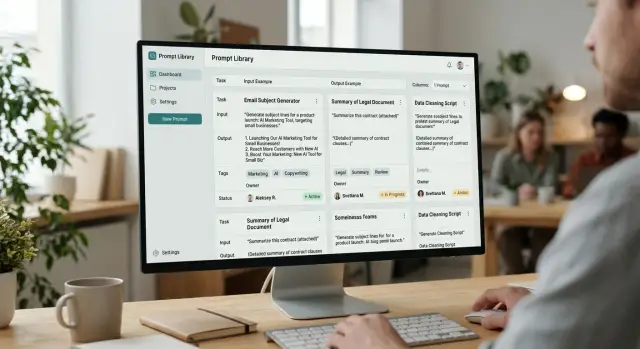

Библиотека промптов для команды: карточки, теги, владельцы

Библиотека промптов помогает команде хранить рабочие шаблоны в одном месте: карточки, теги, владельцы, примеры и порядок обновления.

библиотека промптовкарточка промпта

04 сент. 2024 г.·9 мин чтения

Защита RAG от инъекций в промпт из документов на практике

Защита RAG от инъекций в промпт: как чистить документы, ограничивать инструменты, проверять источник и снижать риск ложных ответов.

защита RAG от инъекций в промптбезопасность RAG

30 авг. 2024 г.·7 мин чтения

Обогащение карточек товаров малыми моделями без лишних затрат

Обогащение карточек товаров можно доверить малой локальной модели, если нужны атрибуты, теги и короткие описания без сложной генерации.

обогащение карточек товаровлокальная модель для атрибутов

24 авг. 2024 г.·11 мин чтения

Модель с открытыми весами: выбор для внутреннего контура

Как выбрать внутреннюю LLM: модель с открытыми весами сравнивают по размеру, языкам, формату ответа и требованиям к GPU на типовых задачах.

модель с открытыми весамивнутренний контур LLM

16 авг. 2024 г.·9 мин чтения

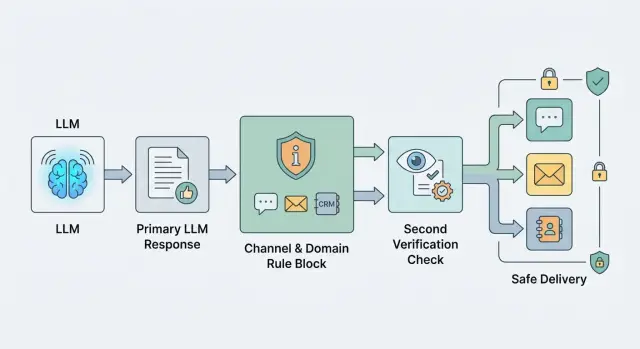

Модерация выходных ответов: где ставить фильтры и вторую модель

Модерация выходных ответов помогает не пропускать рискованный текст в чат, почту и CRM. Разберем, где ставить правила, фильтры и второй вызов.

модерация выходных ответовфильтры для LLM

16 авг. 2024 г.·10 мин чтения

Выбор типа модели для задачи на одном доменном наборе

Выбор типа модели для задачи проще, если прогнать один доменный набор через суммаризацию, извлечение, классификацию и чат и сравнить метрики.

выбор типа модели для задачисравнение суммаризации и извлечения

14 авг. 2024 г.·8 мин чтения

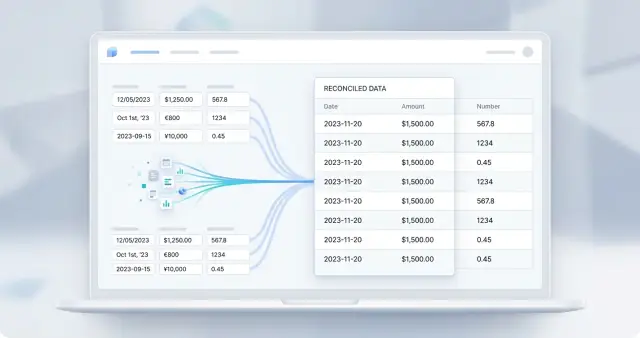

Нормализация дат, валют и чисел после LLM без путаницы

Нормализация дат, валют и чисел помогает привести ответы LLM к одному виду: убрать разнобой в датах, суммах, разделителях и кодах валют.

нормализация дат, валют и чиселформатирование дат после LLM

13 авг. 2024 г.·11 мин чтения

Сессионный контекст и профиль пользователя: как разделить

Сессионный контекст и профиль пользователя нужно хранить отдельно: так ассистент не путает разовые детали, предпочтения, историю и личные данные.

сессионный контекст и профиль пользователяпамять ассистента

07 авг. 2024 г.·8 мин чтения

Зависимость от одного вендора: уход без рефакторинга

Разберем, как снизить зависимость от одного вендора через слой абстракции, тесты совместимости и пошаговую миграцию без крупного рефакторинга.

зависимость от одного вендораслой абстракции для LLM

06 авг. 2024 г.·6 мин чтения

Обрезка контекста LLM без потери смысла: окна и сводки

Обрезка контекста LLM помогает держать диалог в рамках лимита токенов: разберем окна, приоритеты, сводки истории и быстрые проверки.

обрезка контекста LLMокно контекста

04 авг. 2024 г.·9 мин чтения

Размерность эмбеддингов: где ломается поиск и код

Размерность эмбеддингов влияет на поиск, индексы и схемы хранения. Показываем, где падает код, где проседает качество и как пройти миграцию.

размерность эмбеддинговвекторный поиск

03 авг. 2024 г.·7 мин чтения

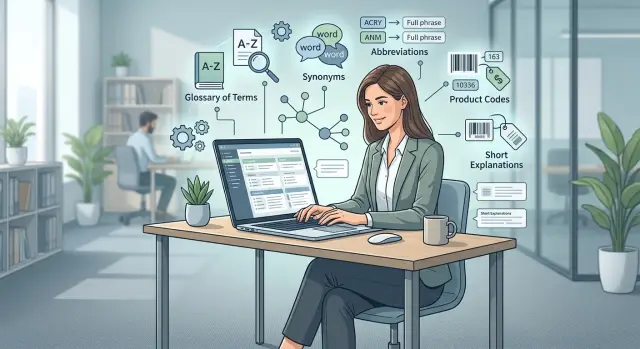

Глоссарий для доменного поиска: часто полезнее модели

Глоссарий для доменного поиска помогает системе понимать термины компании, синонимы и коды. Часто это даёт больше точности, чем смена модели.

глоссарий для доменного поискакорпоративный словарь терминов

29 июл. 2024 г.·10 мин чтения

Таймауты в LLM-цепочке: как разделить лимит времени

Таймауты в LLM-цепочке влияют на ответ не меньше, чем выбор модели. Покажем, как делить общий SLA между шлюзом, поиском, инструментами и моделью.

таймауты в LLM-цепочкебюджет задержки LLM

25 июл. 2024 г.·11 мин чтения

Стоимость LLM в тенге: как собрать годовой бюджет

Покажем, как посчитать стоимость LLM в тенге на год: токены, курсы валют, пики трафика, запас на тесты и понятный бюджет для команды.

стоимость LLM в тенгегодовой бюджет LLM

23 июл. 2024 г.·8 мин чтения

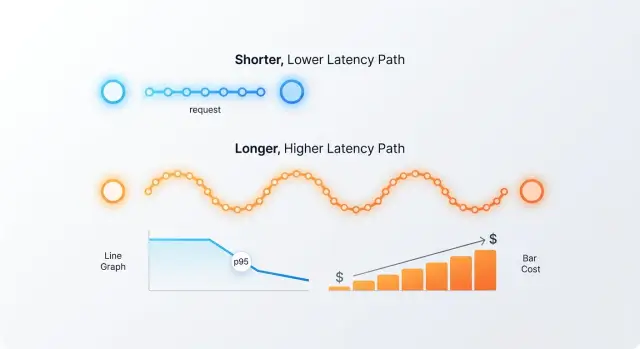

Хеджированные запросы к двум моделям: когда падает p95

Хеджированные запросы к двум моделям помогают убрать редкие долгие ответы, но иногда лишь удваивают расходы. Разберём пороги, метрики и ошибки.

хеджированные запросы к двум моделямснижение p95

17 июл. 2024 г.·6 мин чтения

Черновик и действие в AI-процессе: как ставить барьер

Черновик и действие в AI-процессе помогают не давать модели сразу менять статус заявки, лимит или запись. Разберём правило, шаги и проверки.

черновик и действие в AI-процессеразделение черновика и действия

16 июл. 2024 г.·8 мин чтения

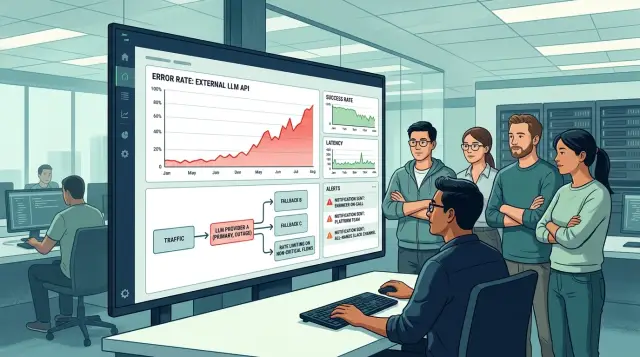

Отказ внешнего LLM-провайдера: план действий на день

Отказ внешнего LLM-провайдера: пошаговый план на день сбоя - как переключить роутинг, ввести лимиты, упростить функции и собрать команды.

отказ внешнего LLM-провайдерароутинг моделей

15 июл. 2024 г.·6 мин чтения

Кто имеет право менять промпты в продакшене: схема

Кто имеет право менять промпты в продакшене: разберём роли, ревью, журнал изменений и откат, чтобы команда не решала всё личными договорённостями.

кто имеет право менять промпты в продакшенероли для промптов

06 июл. 2024 г.·9 мин чтения

Судья-модель для автооценки: где верить, а где проверять

Судья-модель для автооценки помогает быстро проверять ответы, но не везде. Разберём рубрику, ручную выборку и признаки системных ошибок.

судья-модель для автооценкирубрика оценки LLM

03 июл. 2024 г.·6 мин чтения

Пайплайн оценки перед релизом: от набора до регрессий

Пайплайн оценки перед релизом помогает поймать регрессии до выката: как собрать золотой набор, выбрать метрики и сделать отчёт, который читают за 10 минут.

пайплайн оценки перед релизомзолотой набор для LLM