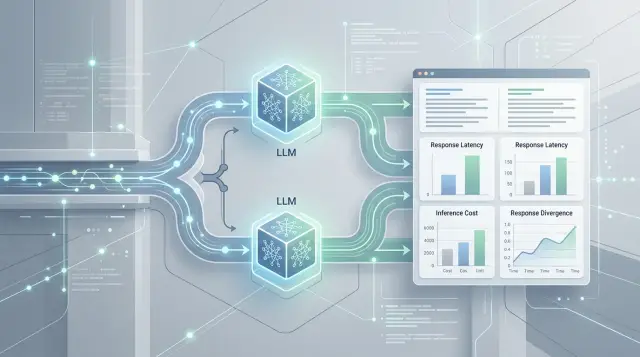

Теневой трафик для смены модели без сбоев и сюрпризов

Теневой трафик для смены модели помогает сравнить ответы, задержку и цену до релиза. Покажем, как считать расхождения и переключаться спокойно.

Почему прямая смена модели дает сюрпризы

Прямая замена модели почти никогда не проходит незаметно. Даже если вы оставили тот же промпт, тот же SDK и тот же API, новая модель отвечает иначе. Меняется тон, длина, порядок блоков и формат вывода. Для человека разница может выглядеть мелкой, но для рабочего сценария это уже другая логика.

Хороший пример - JSON и любые строгие шаблоны. Старая модель могла стабильно отдавать короткий объект без лишнего текста, а новая вдруг добавляет пояснение перед JSON, меняет названия полей или осторожнее формулирует ответ. Пользователь этого почти не заметит. Парсер заметит сразу.

Меняется не только качество текста. У новой модели часто другая задержка, другой средний размер ответа и другая цена на поток. На тесте из двадцати запросов это легко пропустить. На живом трафике лишние 700-900 мс и еще несколько десятков токенов на ответ быстро превращаются в очередь, рост счета и нервный откат назад.

Старые проверки тоже часто успокаивают раньше времени. Команда обычно строит тесты под ошибки, которые уже видела: пустой ответ, битый JSON, запрещенные слова, выход за лимит. Новая модель ошибается по-своему. Она может реже падать формально, но чаще уходить в уклончивый ответ, путать роли, терять детали из длинного контекста или слишком рано отказываться от ответа.

Обычно сюрпризы всплывают уже после релиза. Саппорт замечает, что бот отвечает длиннее и медленнее. Аналитики видят скачок по токенам и стоимости. Интеграция ломается на редких форматах ответа. Бизнес видит проблему не в тестах, а в конверсии или CSAT.

Даже если технически замена очень простая, риск никуда не исчезает. В OpenAI-совместимом шлюзе вроде AI Router можно быстро переключить модель или провайдера без переписывания кода. Это удобно, но именно из-за такой легкости команды иногда недооценивают поведенческие отличия и переводят трафик слишком рано.

Смену модели лучше считать не мелкой настройкой, а отдельным изменением в продукте. Если запросы пользователей живые, прямой свитч почти всегда обходится дороже, чем короткий период проверки в тени.

Когда теневой трафик действительно нужен

Параллельная проверка нужна не всем. Если модель пишет черновики для внутренней команды, риск часто невысокий: человек заметит странный ответ и поправит его. Но если ответ влияет на деньги, сроки или риск, менять модель вслепую не стоит.

Первый явный случай - когда после ответа модели что-то происходит автоматически. Например, LLM выбирает категорию обращения, ставит приоритет тикету, готовит ответ клиенту или вытаскивает поля для договора. Одна и та же ошибка тут стоит не только времени. Она может отправить заявку не туда, задержать платеж или создать спор с клиентом.

Теневой запуск особенно полезен, если у вас давно накопились рабочие промпты под старую модель. На бумаге новая модель может быть сильнее. На деле она иначе читает инструкции, по-другому держит формат и меняет тон ответа. Старый промпт, который месяцами работал спокойно, внезапно начинает давать лишний текст, пропускать поля или слишком уверенно фантазировать.

Есть и более приземленная причина: вы хотите честно сравнить нескольких провайдеров на одних и тех же данных. Без параллельного прогона сравнение быстро портится. Один провайдер получает простые запросы утром, другой - сложные вечером, и выводы уже сомнительные. Теневой режим убирает эту путаницу: оба варианта видят один и тот же поток.

Риск обычно выше в поддержке, продажах, финансах и комплаенсе, а еще в любых сценариях, где следующая система ждет строгий формат ответа. Если ошибка модели отражается на поддержке или продажах, цена промаха быстро становится заметной. Один неудачный ответ сам по себе не страшен. Проблема начинается, когда таких ответов сотни, и команда узнает об этом от клиентов.

Как запустить параллельные запросы

Начинайте не со всего потока, а с копии части реального трафика. Для первого прогона часто хватает одного сегмента: например, только запросов в поддержку или только задач на извлечение данных. Если смешать все сценарии сразу, цифр будет много, а пользы мало.

Каждый запрос отправляйте в две модели одновременно. Первая модель остается рабочей и отвечает пользователю. Вторая работает в тени и ничего не показывает наружу. Так вы проверяете новую модель на живых данных, но не рискуете интерфейсом, SLA и жалобами от клиентов.

Такой тест работает только тогда, когда обе модели получают один и тот же вход. Не меняйте по пути промпт, температуру, лимит токенов или набор tools, если цель - честное сравнение. Иначе потом будет трудно понять, модель ответила иначе или вы просто дали ей другие условия.

Сохраняйте не только финальный текст. Для каждого запроса нужен один и тот же набор данных: промпт и системные инструкции, параметры вызова, ответ текущей модели и ответ новой, задержка по каждой стороне, токены и стоимость. Добавьте к этому идентификатор эксперимента, версию промпта и тип сценария. Через несколько дней это сэкономит часы разбора.

Поток лучше разделить по типам задач еще до запуска. Отдельно смотрите на чат, классификацию, суммаризацию, извлечение полей и генерацию JSON. Модель может писать хорошие тексты, но срываться на структурированном формате. Если все свалить в одну выборку, такой сбой легко пропустить.

Параллельные запросы проще запускать через единый шлюз, где формат вызова уже одинаковый для разных провайдеров. Если команда работает через AI Router, можно отправить копию запроса на другую модель и не собирать новую интеграцию под каждого поставщика. Это полезно не для красоты эксперимента, а чтобы увидеть разницу на живых задачах до переключения.

Что сравнивать кроме общего впечатления

Общее впечатление часто обманывает. Новая модель может писать живее и увереннее, но при этом чаще путать факты, ломать JSON или отвечать дольше в пиковые часы. При теневом запуске полезнее смотреть не на "нравится или не нравится", а на метрики, которые влияют на продукт.

Сначала проверьте, как модель следует инструкции. Отдельно считайте случаи, когда она не выполнила явное требование, и отдельно - когда придумала факт или увела ответ в сторону. Это разные типы сбоев. Бот поддержки, например, может звучать убедительно, но нарушать правило "отвечай только по базе знаний".

Если ответ дальше обрабатывает код, формат важнее стиля. Для JSON смотрят не только на валидность, но и на обязательные поля, допустимые теги, типы значений и пустые поля там, где их быть не должно. Один лишний абзац до JSON может сломать весь сценарий, даже если сам текст выглядит нормально.

Полезно держать короткий чек-лист:

- доля ответов с нарушением инструкции

- доля фактических ошибок на проверочной выборке

- процент невалидного JSON и пропущенных полей

- средняя длина ответа и доля обрезанных ответов

- p50 и p95 по задержке

- стоимость запроса и стоимость всего потока с учетом ретраев

Длина ответа тоже влияет на результат. Слишком длинные ответы дают лишние токены, выше цену и больше задержку. Слишком короткие часто пропускают шаг, оговорку или нужное поле. Отдельно считайте долю обрезанных ответов: когда модель упирается в лимит токенов, заканчивает фразу на полуслове или не закрывает JSON.

По скорости почти всегда нужны две цифры: p50 и p95. p50 показывает обычный опыт пользователя. p95 показывает неприятные хвосты, которые и создают жалобы. Если медиана почти не изменилась, а p95 вырос вдвое, новая модель уже может быть плохим выбором для чата, агента или API-цепочки.

С ценой та же история. Смотрите не только стоимость одного запроса, но и стоимость всего потока. Дешевая модель легко становится дороже, если она пишет на 25% длиннее, чаще вызывает ретраи или просит повторный запрос из-за сломанного формата.

Хорошая замена редко выигрывает по одной цифре. Обычно она должна пройти порог сразу по четырем вещам: точность, формат, задержка и бюджет. Если хотя бы одна из них проседает, сюрпризы после переключения почти гарантированы.

Как считать расхождения без путаницы

Теневой запуск чаще ломается не на самих запросах, а на оценке. Команда видит средний матч 90% и думает, что новая модель готова, хотя она может регулярно ошибаться в одном узком, но дорогом сценарии.

Сначала задайте три порога и закрепите их до теста. Иначе люди начнут спорить уже после первых спорных ответов.

- Успех: ответ совпал по смыслу, прошел проверку структуры, не нарушил правила безопасности и не раскрыл PII.

- Провал: модель изменила решение, сломала формат, выдала рискованный текст или пропустила чувствительные данные.

- Серая зона: смысл почти тот же, но ответ требует ручной проверки. Например, модель выбрала верную категорию, но добавила лишнее объяснение или неуверенно сформулировала итог.

Автоматические тесты лучше ставить не только на текст, но и на форму ответа. Если приложение ждет JSON, проверяйте схему, обязательные поля, типы, enum-значения и названия tool calls. Одна сломанная скобка не выглядит страшно в отчете, но в проде она может остановить целый сценарий.

Безопасность и PII считайте отдельно от обычного качества. Тут средняя оценка мало что говорит. Если новая модель даже в 0,5% случаев перестает маскировать ИИН, номер карты или телефон, это уже не "небольшое отличие", а стоп-сигнал.

Средние цифры по всем запросам часто прячут проблему. Разбейте трафик хотя бы по типу задачи, языку, длине промпта и сегменту пользователей. Условные 93% совпадения по общей массе ничего не значат, если в длинных запросах на казахском модель проседает до 74%.

Полезно смотреть и на цену ошибки. Для черновика письма расхождение в стиле можно отправить в серую зону. Для банковского чат-бота неверный статус заявки или лишнее поле в JSON лучше сразу считать провалом.

Спорные случаи не копите в общей куче. Берите ручную выборку по каждому сегменту и проверяйте ее по одной шкале. Обычно хватает 30-50 примеров на сегмент, если вы выбрали самые частые и самые рискованные запросы.

Когда команда ведет отдельный счет для структуры, смысла, безопасности и PII, решение о переключении становится спокойнее. Уже видно не "модель вроде лучше", а где она действительно проходит тест, а где ее пока рано выпускать.

Пример на простом рабочем сценарии

Представьте бота поддержки интернет-магазина. Чаще всего он отвечает на простой вопрос: "Где мой заказ 483921?" Пользователь ждет один короткий ответ со статусом, а не длинный диалог. Команда хочет попробовать новую модель, потому что она заметно быстрее на таких сообщениях.

Сразу переключать всех рискованно. Старая модель уже хорошо читает номер заказа даже в кривом тексте, где клиент пишет без знаков препинания или добавляет лишние слова. Если новая модель один раз перепутает номер, бот покажет чужой статус или ответит, что заказ не найден. Для поддержки это лишние жалобы и ручная работа.

Поэтому команда включает теневой режим. Бот по-прежнему показывает ответ старой модели, но система параллельно отправляет тот же запрос новой модели и сохраняет оба результата. Для каждого обращения команда смотрит на четыре простые вещи: какой номер заказа извлекла каждая модель, совпал ли итоговый статус, сколько занял ответ и попросила ли модель лишнее уточнение.

Через несколько дней картина становится ясной. На коротких вопросах вроде "Статус заказа 483921" новая модель отвечает в среднем на 0,7 секунды быстрее и почти не расходится со старой. Но на длинных цепочках, где клиент сначала спорит о доставке, потом вспоминает старый номер и в конце просит проверить новый заказ, новая модель чаще теряет контекст. Она может взять первый номер из переписки вместо последнего или повторно спросить то, что уже было в чате.

Тут команде не нужен один общий вердикт по всей модели. Она делит трафик на два типа. Простые кейсы, где есть один явный номер заказа и не больше двух сообщений, можно перевести на новую модель довольно быстро. Сложные диалоги лучше пока оставить на старой, а новой дать доработанный промпт, более жесткий формат ответа или отдельную проверку номера заказа перед отправкой.

Такой подход убирает лишний риск. Команда не спорит о том, какая модель лучше в целом. Она видит, где новая модель уже годится для продакшена, а где ее еще рано выпускать на живых клиентов.

Частые ошибки при теневом запуске

Самая частая ошибка выглядит безобидно: команды сравнивают две модели в разных условиях. У одной temperature 0.2, у другой 0.8. У одной лимит 300 токенов, у другой 1200. Иногда меняют даже системный промпт и потом спорят, какая модель хуже. Такой тест ничего не доказывает. Если вы проверяете новую модель в тени, сначала выровняйте все параметры генерации, формат ответа и правила постобработки.

Даже одинаковый SDK не спасает от путаницы. Если команда просто меняет base_url на другой LLM-шлюз, код может остаться прежним, но поведение модели все равно будет другим. Поэтому сравнивать нужно не "старую интеграцию" с "новой интеграцией", а две модели при одной и той же обвязке.

Вторая ошибка - делать вывод по слишком маленькой выборке. Десять или двадцать запросов годятся только для первого взгляда. Они не показывают редкие, но дорогие сбои: пропуск обязательного поля, слишком длинный ответ, неверный тон, уход от инструкции. Обычно проблема всплывает на сотом или тысячном запросе, когда в поток попадают длинные диалоги, шумный ввод и странные формулировки.

Еще одна ловушка - смотреть только на среднюю задержку. Среднее число часто выглядит прилично, даже если у модели длинный хвост по времени ответа. Пользователь замечает не среднее, а зависания, таймауты и скачки. Смотрите хотя бы на p95, долю ошибок, длину ответа и число повторных запросов после неудачи.

Часто команды смешивают в одном отчете безопасные и рискованные сценарии. Простые FAQ, извлечение полей из формы и черновики писем нельзя оценивать по тем же правилам, что кредитный скоринг, медицинские подсказки или ответы для госуслуг. У этих задач разная цена ошибки. Модель может отлично писать короткие summaries и при этом плохо держать строгий JSON в формах или путать обязательные предупреждения.

Последняя ошибка самая дорогая: новая модель проходит теневой тест, и ее сразу включают всем пользователям. Лучше идти ступенчато. Сначала внутренние пользователи, потом небольшой процент реального трафика, потом отдельные сегменты. Если что-то пойдет не так, вы быстро откатитесь без шума и без длинного списка инцидентов.

Быстрая проверка перед переключением

Переключать трафик на новую модель стоит только после короткой, но жесткой проверки. Если качество стало выше на части запросов, а задержка выросла вдвое, вы получите новые жалобы вместо пользы. То же самое с ценой: небольшой прирост точности не всегда оправдывает рост счета.

До переключения команда должна зафиксировать пороги. Обычно это простой набор: минимальный уровень качества, верхняя граница по задержке и понятный предел по стоимости одного запроса или всей цепочки вызовов. Если новая модель не проходит хотя бы один порог, ее рано выводить в основной трафик.

Нужен дашборд или хотя бы таблица с порогами по качеству, задержке и цене для каждого важного типа запросов. Нужен журнал спорных и плохих ответов с примерами промпта, ответа, эталона и короткой пометкой, что именно пошло не так. Нужен план отката: кто принимает решение, как вернуть старую модель и сколько минут это занимает. И нужен мониторинг по типам запросов, а не только по средней цифре. Суммарная метрика слишком часто прячет провалы в узких сценариях.

Журнал спорных ответов полезен даже при хороших средних метриках. Именно в нем всплывают опасные мелочи: новая модель уверенно придумывает реквизиты, чаще теряет шаг в инструкции или хуже держит формат JSON. Пять таких примеров часто говорят больше, чем красивый общий график.

План отката лучше проверить руками. Один ответственный человек должен знать, что делать, если через 10 минут после роста доли трафика вырастет число ошибок или просядет конверсия. Если модель меняется через совместимый шлюз вроде AI Router, проверьте заранее, что возврат на старую модель сводится к смене маршрута или конфигурации, а не к правкам кода на ходу.

Средние значения редко спасают. Отдельно смотрите поиск, суммаризацию, извлечение данных, поддержку, генерацию кода и другие ваши сценарии. Когда команда заранее знает, при каком сигнале поднимать долю трафика и при каком сразу откатываться, переход проходит заметно спокойнее.

Что делать после успешного теста

Даже после хорошего результата не переключайте весь поток сразу. Любой тест пропускает редкие случаи. Реальный трафик почти всегда приносит новые формулировки, длинные диалоги и неожиданные комбинации данных.

Начните с маленькой доли живых запросов. Часто хватает 1-5% на первый этап, потом 10%, 25%, 50% и только после этого 100%. Между этапами дайте системе поработать хотя бы несколько часов, а для важных сценариев - день.

Обычно помогает простой порядок действий:

- включить новую модель на малой доле трафика

- следить за ошибками, задержкой, стоимостью и жалобами пользователей

- поднимать долю только если метрики не просели

- держать старую модель как быстрый откат

- отдельно проверять спорные случаи после каждого этапа

Старую модель лучше не убирать сразу. Подержите ее рядом еще несколько дней, а для чувствительных задач - неделю. Это особенно полезно, когда всплывает редкий сценарий: например, новая модель хорошо отвечает в чате, но хуже обрабатывает короткие запросы на классификацию обращений.

Хорошая практика - сохранить простой флаг переключения. Тогда дежурный инженер или владелец сервиса сможет вернуть прежнюю модель за минуты, без спешных правок в коде.

Через первую неделю пересмотрите промпты. Часто проблема уже не в самой модели, а в старых инструкциях, которые писали под другой стиль ответа. Новая модель может просить лишние пояснения, менять формат JSON или по-другому работать с длинным контекстом. Небольшая правка промпта иногда дает больший эффект, чем еще один раунд выбора модели.

Если вы часто сравниваете провайдеров или тестируете несколько моделей параллельно, удобнее держать один OpenAI-совместимый эндпоинт. В AI Router команда меняет base_url на api.airouter.kz и продолжает использовать те же SDK, код и промпты. Это упрощает поэтапный выкат и откат.

Для команд в Казахстане есть еще одна практическая проверка перед полным запуском: убедитесь, что хранение данных, аудит-логи и маскирование PII настроены так же строго, как во время теста. На бумаге миграция может выглядеть удачной, но продакшен часто ломается именно на таких деталях.

Если через несколько дней метрики ровные, ручная проверка не находит неприятных сюрпризов, а поддержка не видит новых жалоб, тогда новую модель уже можно считать основной.

Часто задаваемые вопросы

Зачем вообще нужен теневой трафик при смене модели?

Потому что прямая замена модели меняет не только текст, но и поведение сервиса. Теневой трафик дает посмотреть на живые запросы, сравнить ответы, задержку и цену, но не ломать интерфейс для пользователей.

Когда можно не делать теневой запуск?

Можно обойтись без него, если модель пишет черновики для внутренней команды, а человек все проверяет руками перед отправкой. Если ответ запускает действие, влияет на деньги, сроки или строгий формат, менять модель вслепую не стоит.

Какой трафик лучше взять для первого прогона?

Для старта берите один понятный сегмент, а не весь поток сразу. Чаще всего хватает запросов одного типа, например поддержки или извлечения полей, чтобы быстро увидеть реальные сбои и не утонуть в шуме.

Что должно совпадать у основной и теневой модели?

Оставьте одинаковыми промпт, системные инструкции, temperature, лимит токенов и tools. Если вы меняете сразу и модель, и условия вызова, потом никто не поймет, что именно дало расхождение.

Какие метрики смотреть в первую очередь?

Сначала смотрите на соблюдение инструкции, валидность формата, p50 и p95 по задержке, длину ответа и итоговую стоимость потока. Общего впечатления мало: модель может писать приятнее, но чаще ломать JSON или отвечать дольше в пике.

Как понять, что расхождение уже опасно?

Смотрите на цену ошибки, а не только на похожесть текста. Если модель меняет статус заявки, раскрывает PII, ломает JSON или уводит ответ от правила, считайте это провалом, даже когда формулировка выглядит почти такой же.

Как проверять JSON и другие строгие форматы?

Проверяйте не только валидность JSON, но и схему целиком: обязательные поля, типы значений, enum и лишний текст до объекта. Один абзац перед JSON или пустое поле в нужном месте ломает сценарий так же быстро, как битая скобка.

Сколько запросов нужно, чтобы сделать вывод?

Десяти или двадцати запросов хватает только на быстрый просмотр. Для решения о переключении нужен поток, где встречаются длинные диалоги, шумный ввод и редкие кейсы; отдельно полезно руками проверить хотя бы 30–50 примеров на каждый рискованный сегмент.

Как безопасно переводить пользователей на новую модель?

После теста не включайте новую модель всем сразу. Дайте ей малую долю живого трафика, следите за ошибками, задержкой, ценой и жалобами, а старую модель держите рядом как быстрый откат.

Что делать, если новая модель хороша не во всех сценариях?

Не ищите один общий вердикт по всей модели. Разделите трафик по сценариям и переведите на новую модель только те случаи, где она уже держит качество, формат и скорость; остальное оставьте на старой или поправьте промпт.