Спекулятивное декодирование: где ускоряет, а где нет

Спекулятивное декодирование не всегда ускоряет LLM. Покажем, где черновая модель реально снижает задержку, а где съедает выигрыш.

Почему ответ не всегда приходит быстрее

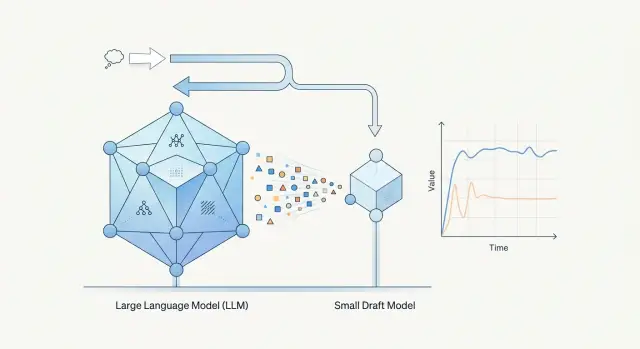

Спекулятивное декодирование добавляет в генерацию еще один шаг. Сначала маленькая черновая модель быстро предлагает несколько следующих токенов. Потом большая модель проверяет их и либо принимает, либо отклоняет. На схеме это выглядит как простой способ ускорить ответ. В реальной системе все сложнее: проверка тоже требует времени и вычислений.

Поэтому маленькая модель не дает автоматического выигрыша. Она должна достаточно часто угадывать продолжение. Если она ошибается слишком рано, большая модель тратит ресурсы не только на обычную генерацию, но и на постоянную перепроверку чужих догадок. Часть времени просто сгорает.

Это похоже на работу редактора. Если черновик почти готов, редактор быстро его подтверждает и идет дальше. Если текст слабый, проще переписать с нуля. С моделями логика та же.

Разница особенно заметна на коротких ответах. Когда системе нужно вернуть 20-30 токенов, например метку, короткий итог звонка или ответ в стиле "да" или "нет", накладные расходы легко съедают весь эффект. Время уходит на запуск черновой модели, передачу гипотез и проверку основной моделью. В итоге обычная генерация нередко оказывается быстрее просто потому, что в ней меньше шагов.

На длинных и более предсказуемых ответах картина часто лучше. Если модель пишет типовой текст, структурированную сводку или кусок кода с понятным шаблоном, черновая модель чаще попадает в нужное продолжение. Тогда большая модель принимает сразу несколько токенов за один проход, и задержка заметно снижается.

Обычно все упирается в четыре вещи: как часто черновая модель угадывает продолжение, какой длины ответы вы получаете, насколько быстро основная модель умеет проверять пачку токенов и сколько сетевых или серверных расходов добавляет сама схема.

Из-за этого одна и та же пара моделей ведет себя по-разному на разных задачах. Для короткого ответа юрбота выигрыш может исчезнуть. Для длинной сводки разговора в колл-центре он уже виден. Если команда проверяет только один сценарий, она легко делает неверный вывод.

В продакшене лучше не ждать чуда от самой идеи. Сначала стоит ответить на более простой вопрос: на каких запросах черновая модель стабильно угадывает, а большая проверяет быстрее, чем генерирует с нуля. Только там схема обычно окупается.

Как работает схема без формул

При спекулятивном декодировании работают две модели, а не одна. Маленькая модель предлагает продолжение, а целевая модель решает, какие токены можно оставить. Черновая модель нужна не ради качества ответа. Она нужна ради скорости.

Сам цикл простой:

- Черновая модель предлагает несколько следующих токенов.

- Основная модель проверяет этот фрагмент за один проход.

- Если прогноз совпал, система принимает сразу несколько токенов.

- Если черновая модель ошиблась, система отбрасывает хвост и продолжает с точки расхождения.

Ускорение появляется не из-за самого факта, что в схеме есть маленькая модель. Его дают серии принятых токенов. Если черновая модель часто угадывает, большая модель подтверждает сразу куски текста, и ответ идет быстрее. Если угадывает плохо, система тратит время и на черновик, и на проверку, а выигрыш быстро тает.

Хороший пример - шаблонная сводка звонка. Фраза вроде "Клиент пожаловался на задержку доставки, попросил обратный звонок" достаточно предсказуема по форме. Для таких фрагментов черновая модель часто угадывает и слова, и порядок. Тогда основная модель подтверждает несколько токенов подряд.

Здесь важно не путать два разных показателя. Первый - время до первого токена. Это скорость, с которой пользователь увидел начало ответа. Второй - полное время ответа, то есть как быстро система выдала весь текст после старта.

Спекулятивное декодирование чаще помогает именно на длинном продолжении. Первый токен может почти не ускориться, а иногда даже прийти чуть позже из-за дополнительного шага с черновой моделью. Зато на ответе в 200-500 токенов выигрыш бывает вполне заметным, если черновая модель хорошо угадывает стиль и структуру текста.

Поэтому оценивать такую схему по одному числу нельзя. Если смотреть только на первый токен, можно решить, что пользы нет. Если смотреть только на среднюю скорость длинных ответов, можно не заметить, что интерфейс стал менее отзывчивым в самом начале.

Что измерять до выводов

Если смотреть только на среднее время ответа, вывод легко окажется неверным. Среднее скрывает длинные задержки, а именно их пользователи запоминают лучше всего. Рядом со средним стоит держать медиану и хотя бы p95. Тогда видно, ускорение работает почти всегда или только на удобных запросах.

Отдельно меряйте время до первого токена и время до конца ответа. Для пользователя это два разных ощущения. Модель может начать отвечать чуть раньше, но закончить почти в то же время. Бывает и наоборот: первый токен не меняется, зато длинный ответ собирается заметно быстрее.

У спекулятивного декодирования есть и прямой индикатор: доля черновых токенов, которые большая модель приняла без пересчета. Если черновая модель часто угадывает, схема дает выигрыш. Если основная модель постоянно отклоняет ее предложения, вы платите за лишнюю работу и теряете время на проверке.

Полезно смотреть не только на общий процент принятия, но и на разбивку по типам запросов. На коротких формализованных ответах, строгом JSON и задачах с повторяющимися шаблонами принятие часто выше. На сложных рассуждениях, редких терминах и длинном коде оно обычно падает.

Еще одна типичная ошибка - сравнивать стоимость и задержку на разных наборах запросов. Так делать нельзя. Нужны одна и та же выборка, одинаковые параметры генерации, одинаковый лимит токенов и одинаковые условия нагрузки. Иначе вы не поймете, помогла схема или просто изменился профиль запросов.

Минимальный набор метрик обычно такой:

- медиана, среднее и p95 по задержке;

- время до первого токена и полное время ответа;

- доля принятых черновых токенов;

- цена одного ответа и цена 1000 выходных токенов.

Если хотите проверить схему честно, возьмите хотя бы 100-200 реальных запросов из продакшена без ручного отбора удачных примеров. После этого сравните обычную генерацию и связку "черновая модель + основная модель" на одном и том же наборе. Уже на этом этапе обычно видно, где есть реальный выигрыш, а где цифры красиво выглядят только в среднем отчете.

Где выигрыш обычно есть

Спекулятивное декодирование чаще помогает там, где ответ длинный и предсказуемый по форме. Если модель пишет сводку по шаблону, перечисляет найденные поля или выдает объяснение в заданной структуре, маленькая модель нередко угадывает следующий кусок текста достаточно точно. Тогда большая модель подтверждает сразу несколько токенов, и пауз между шагами становится меньше.

Хороший пример - суммаризация звонков в колл-центре. Во многих командах итог похож из раза в раз: причина обращения, действия оператора, результат разговора, нужен ли повторный контакт. Формулировки меняются, но каркас ответа остается почти тем же. На таком потоке ускорение вывода LLM обычно видно быстрее, чем на свободном диалоге или творческом тексте.

Чаще всего выигрыш есть в задачах, где модель идет по узкой колее: в сводках звонков и встреч, при извлечении полей из писем и заявок, в ответах поддержки по стандартным сценариям, в коротких отчетах с фиксированными разделами. Во всех этих случаях черновая модель не обязана быть очень сильной. Ей достаточно часто попадать в ожидаемый ритм ответа: служебные слова, маркеры, типовые связки, повторяющиеся конструкции. Чем меньше неожиданностей в тексте, тем больше подтверждений подряд получает основная модель.

Пара моделей тоже имеет большое значение. Лучше работают не абстрактные сочетания "маленькая плюс сильная", а пары, где маленькая модель пишет примерно в том же стиле и порядке. Такое нередко бывает у моделей одного семейства или у тех, что обучались на похожих инструкциях. Если основная модель любит длинные оговорки, а черновая отвечает резко и сухо, совпадений будет мало.

Есть и чисто прикладная сторона. Ускорение заметнее там, где координация между двумя моделями обходится дешево. Если обе модели уже прогреты, находятся близко к пользователю и не требуют лишних сетевых прыжков, выигрыш сохраняется. Если на каждую проверку уходит дополнительный запрос в другой регион или к другому провайдеру, лишняя задержка быстро съедает пользу.

По этой причине такой подход часто лучше показывает себя на повторяемых серверных задачах, чем в разовом демо. Если команда тестирует разные пары моделей через единый шлюз вроде AI Router, удобнее всего смотреть на длинные структурные ответы и сравнивать результат по одинаковым потокам запросов, а не по одному удачному примеру.

Где выигрыш быстро исчезает

Спекулятивное декодирование почти не дает бонуса, когда черновая модель редко угадывает продолжение. Тогда основная модель отклоняет ее варианты, и система тратит время на лишний круг работы вместо ускорения.

Самый частый случай - очень короткие ответы. Если ассистент обычно пишет одно-два предложения вроде "Да, документ принят" или "Попробуйте позже", задержку создает не длинная генерация, а запуск моделей, передача запроса и проверка черновика. На таких ответах ускорять почти нечего.

Проблемы начинаются и там, где текст трудно предсказать. Это видно на задачах со сложным рассуждением, точными терминами, кодами товаров, именами, номерами договоров и другими редкими токенами. Черновая модель чаще ошибается уже в начале, а основная тратит шаги на исправление.

Слабая черновая модель тоже быстро съедает весь эффект. Если она заметно хуже основной не только по качеству, но и по стилю продолжения, вы получаете сразу две проблемы: больше отказов при проверке и сильнее разброс по задержке. В одном запросе все проходит быстро, а в другом ответ выходит медленнее обычной генерации.

Чаще всего схема не окупается в четырех случаях: ответ сам по себе очень короткий, в тексте много чисел и редких токенов, черновая модель расходится с основной уже на первых шагах, а проверка черновика почти так же дорога, как обычная генерация.

Последний пункт часто недооценивают. Проверка тоже требует вычислений. Если вы выбрали слишком близкую по размеру пару моделей, держите длинный контекст или упираетесь в память и очередь, экономия становится почти незаметной. По замерам это выглядит неприятно: система сложнее, а скорость меняется совсем чуть-чуть.

Полезно смотреть не только на среднюю задержку. Сравните медиану, p95 и долю принятых черновых токенов по разным типам запросов. Если короткие ответы не стали быстрее, а на сложных запросах основная модель часто отвергает черновик, лучше оставить обычную генерацию и не усложнять стек без пользы.

Как проверить это на своих задачах

Начните с одной частой задачи. Не смешивайте в один тест чат, суммаризацию, извлечение полей и генерацию писем. Иначе вы получите усредненную цифру, которая ничего не объясняет. Если пользователи чаще всего просят короткую классификацию заявки, тестируйте именно ее.

Потом соберите нормальную выборку запросов. В ней нужны не только типичные примеры, но и разная длина ответа: совсем короткие, средние и длинные. Часто именно на длинных ответах спекулятивное декодирование дает выигрыш, а на коротких почти не меняет задержку. Если смешать их без разбивки, вывод будет ложным.

Дальше прогоните два режима на одинаковых настройках. В первом оставьте только основную модель. Во втором добавьте черновую. Не меняйте температуру, max tokens, системный промпт, кэш и параллелизм. Любая такая правка ломает сравнение.

Смотреть лучше не на одну метрику, а на набор: p50 и p95 по времени ответа, стоимость одного запроса и всей выборки, качество на одной и той же проверке и долю запросов, где ускорение вообще появилось.

Качество лучше проверять не по двум удачным ответам, а по простому правилу. Для суммаризации это может быть полнота фактов, для классификации - точность метки, для извлечения данных - число верно заполненных полей. Если скорость выросла на 15%, а ошибок стало больше, такой тест нельзя считать успешным.

После этого замените черновую модель и повторите прогон. На практике это часто полезнее, чем долгие споры о самой идее. Одна маленькая модель хорошо угадывает продолжение текста и правда ускоряет вывод LLM, а другая тратит токены впустую. Пара моделей решает больше, чем кажется.

Если у вас уже есть единый OpenAI-совместимый шлюз вроде AI Router, такой тест проще провести аккуратно: можно менять пары моделей через один и тот же API и не трогать остальной код. Это удобно, потому что вы проверяете именно влияние пары моделей, а не побочные изменения в интеграции.

Хороший результат выглядит скучно, и это нормально: одна задача, одна выборка, одинаковые настройки, понятная разница по p50, p95, цене и качеству.

Пример: сводка звонка в колл-центре

Возьмем обычный звонок в поддержку на 8-10 минут. Клиент долго объясняет проблему: заказ приехал не туда, оператор уже менял адрес, деньги списались дважды, а в чате ответа нет. После разговора системе нужно сделать короткую, но содержательную сводку для CRM.

В такой задаче спекулятивное декодирование часто дает нормальный выигрыш. Причина простая: итоговый ответ длиннее одной реплики, и в нем много предсказуемых фрагментов. Черновая модель легко угадывает типовые куски вроде "клиент сообщил", "оператор проверил заказ", "нужна повторная проверка оплаты". Если сильная модель подтверждает эти токены подряд, система выдает текст быстрее.

Если сводка занимает 80-150 токенов, накладные расходы проще окупить. Черновая модель успевает продвинуться вперед, а сильная не тратит время на генерацию каждого слова с нуля. Особенно это заметно там, где структура ответа почти всегда похожа: причина обращения, что уже сделали, что обещали клиенту, следующий шаг.

Теперь сравним это с другой задачей. После проверки оператору нужен ответ в одну строку: "Статус заявки?" Система должна вернуть одно предложение вроде "Заявка передана во вторую линию, ответ ожидается до 18:00".

Тут текста мало. Иногда это всего 10-20 токенов. Черновая модель почти не успевает ничего сэкономить, зато добавляет свой проход. Если в ответе есть номер заявки, время, сумма или имя клиента, сильная модель чаще перепроверяет спорные токены. Доля принятых токенов падает, и выигрыш исчезает.

Есть и второй момент. В коротком ответе люди сильнее замечают задержку до первого слова, чем общую скорость вывода. Поэтому даже небольшой дополнительный шаг перед проверкой может испортить ощущение быстроты, хотя на длинной сводке тот же подход дал бы хороший результат.

Если команда подбирает пары моделей через AI Router, такой сценарий удобно прогнать на одном и том же потоке звонков. Обычно картина быстро проясняется: длинные сводки ускоряются заметнее, а ответы в одну фразу часто почти не выигрывают.

Где команды ошибаются при тестах

Чаще всего команды ломают эксперимент еще до первых цифр. Они меняют сразу две вещи: промпт и пару моделей. Потом видят разницу во времени ответа и уже не понимают, что сработало на деле - новый текст запроса, другая черновая модель или сама схема.

Со спекулятивным декодированием это особенно заметно. Один и тот же промпт может давать короткий уверенный ответ, а после маленькой правки - длинный ответ с оговорками, таблицей или списком. Тогда вы сравниваете уже не скорость метода, а совсем другую нагрузку.

Еще одна частая ошибка - смотреть только на среднее время. Среднее легко выглядит красиво, даже если каждый десятый запрос внезапно тормозит. Для продакшена хвост задержек часто важнее среднего. p95 и p99 быстро показывают, где схема начинает сыпаться.

Маленькая выборка тоже обманывает. Если команда прогнала 20 или 30 запросов и увидела выигрыш в одном удобном сценарии, это еще ничего не доказывает. Нужны десятки, а лучше сотни реальных запросов с разной длиной ответа, разной структурой и разной сложностью.

Часто забывают смотреть на две вещи: длину ответа и долю принятых черновых токенов. Если большая модель часто отвергает предложения черновой модели, выигрыш тает очень быстро. На коротких ответах это особенно заметно: накладные расходы уже есть, а сэкономить почти не на чем.

Нормальный тест обычно выглядит так:

- один и тот же промпт и один набор параметров генерации;

- один и тот же набор запросов для базовой схемы и для спекулятивного декодирования;

- сравнение не только среднего, но и p50, p95, p99;

- разбивка результатов по длине ответа;

- отдельный расчет доли черновых токенов, которые приняла основная модель.

Хороший контрпример быстро отрезвляет. Допустим, на задачах краткой классификации пара моделей дает минус 18% к задержке. Команда радуется и переносит вывод на весь сервис. Но на длинных юридических сводках та же пара может дать ноль или даже просадку, потому что черновая модель слишком часто ошибается, а основная тратит время на проверки.

Если вывод держится только на одном удачном наборе запросов, это не вывод. Это просто удачный день для теста.

Перед запуском

Спекулятивное декодирование редко стоит включать по умолчанию для всех запросов. Оно имеет смысл там, где черновая модель часто угадывает продолжение, а основная подтверждает эти токены без долгих откатов.

Перед запуском полезно проверить несколько вещей. Посмотрите на длину ответов. Если модель обычно пишет 20-40 токенов, выигрыш часто съедают накладные расходы. Если ответы длиннее, эффект заметнее. Затем проверьте, похожи ли ответы друг на друга по форме. Сводки звонков, карточки обращений, извлечение полей и шаблонные письма подходят лучше, чем свободный брейнсторминг или сложный анализ.

Дальше измеряйте не только среднюю скорость. Вам нужны доля принятых токенов, время до первого токена и p95 по полной длине ответа. Среднее значение легко рисует красивую картину, а пользователи потом видят медленные хвосты. И обязательно сравнивайте качество на реальных данных, а не на пяти удачных промптах. Если черновая модель часто уводит основную в неверную ветку, ускорение не окупает потери.

Еще до запуска полезно решить, где схема не нужна. Для коротких ответов, низкой доли принятия или дорогих откатов лучше быстро отключать этот режим, а не держать его ради самой идеи.

Хороший признак выглядит так: длинные ответы со схожей структурой, стабильное принятие токенов и заметное снижение p95. Плохой признак проще: среднее время стало чуть лучше, но хвосты длиннее, а качество плавает.

На практике команды часто запускают спекулятивное декодирование на одном сценарии, видят плюс 15-20%, а потом переносят результат на все задачи. Так делать не стоит. Даже в одной системе часть маршрутов может выигрывать, а часть нет. Если вы тестируете это через единый шлюз вроде AI Router, разумно включать режим выборочно по типу запроса, а не для всего трафика сразу.

Что делать дальше

Не раскатывайте спекулятивное декодирование на весь трафик сразу. Начните с одной задачи, где ответ длиннее пары фраз и где задержка заметна пользователю или оператору. Для пилота подойдут сводка звонка, ответ ассистента в чате поддержки или извлечение полей из длинного документа.

Сразу выберите метрики, иначе тест быстро превратится в спор по ощущениям. Обычно хватает четырех: p50 и p95 по задержке, доля принятых токенов от черновой модели, стоимость на 1000 запросов и разница в качестве на небольшой ручной выборке. Если качество плавает, скорость уже не спасает.

Полезно заранее записать порог успеха. Например, схема считается удачной, если p95 падает хотя бы на 20%, качество не проседает, а цена растет не больше чем на 5%. У каждой команды цифры будут свои, но сам порог нужен обязательно. Иначе тест можно тянуть неделями и каждый раз трактовать результат по-разному.

План действий тоже должен быть простым: выберите одну пару моделей и один тип запроса, прогоните одинаковый набор примеров без схемы и со схемой, отделите короткие запросы от длинных и зафиксируйте, когда метод помогает, а когда мешает.

План отката нужен с первого дня. Короткие запросы, ответы на одно-два предложения и сложные рассуждения часто съедают весь выигрыш. Для таких случаев лучше сразу задать правило: если запрос короче выбранного порога, если доля принятых токенов падает ниже нормы или если растет число исправлений в ответе, система возвращается к обычному режиму.

Если команда уже сравнивает модели через AI Router, такой тест провести проще. Можно менять пары моделей и маршрутизацию на стороне шлюза, не трогая клиентский код, SDK и промпты. Это экономит время и снижает риск: инженеры быстрее получают честные цифры, а не тратят неделю на переписывание интеграции ради одного эксперимента.

Хороший следующий шаг совсем простой: выберите один сценарий, задайте порог пользы, прогоните 500-1000 реальных запросов и сохраните результат в таблице. После этого уже видно, стоит ли масштабировать схему дальше.

Часто задаваемые вопросы

Что такое спекулятивное декодирование простыми словами?

Это схема с двумя моделями. Маленькая модель быстро предлагает несколько следующих токенов, а большая сразу проверяет этот кусок и оставляет только то, что совпало. Выигрыш появляется тогда, когда большая модель подтверждает подряд не один токен, а сразу несколько.

Почему спекулятивное декодирование не всегда ускоряет ответ?

Потому что схема добавляет лишний шаг. Сначала работает черновая модель, потом большая тратит время на проверку, и при слабом совпадении эта проверка съедает весь плюс. На коротких ответах это видно особенно часто.

На каких задачах схема обычно дает выигрыш?

Лучше всего метод показывает себя на длинных и похожих по форме ответах. Подойдут сводки звонков, извлечение полей, шаблонные ответы поддержки и короткие отчеты с фиксированной структурой. В таких задачах черновая модель чаще угадывает продолжение.

Когда лучше оставить обычную генерацию?

Не включайте его для очень коротких ответов, строгих однофразовых реплик и задач с редкими токенами. Номера договоров, суммы, имена, коды товаров и сложные рассуждения быстро снижают долю совпадений. В таком случае обычная генерация часто выходит быстрее и проще.

Ускоряет ли схема время до первого токена?

Чаще всего нет. Первый токен может прийти почти в то же время или даже чуть позже, потому что система сначала запускает черновую модель. Зато на длинном ответе общее время нередко падает заметнее.

Какие метрики стоит мерить в тесте?

Смотрите не на одно среднее число, а сразу на p50, p95, время до первого токена, полное время ответа и долю принятых черновых токенов. Еще посчитайте цену одного ответа и цену на 1000 выходных токенов. Тогда вы увидите не только быстрые удачные случаи, но и медленные хвосты.

Сколько запросов нужно для честной проверки?

Для первого вывода обычно хватает 100–200 реальных запросов, если выборка честная и без ручного отбора. Если трафик сильно разнится по длине и типу ответов, берите 500–1000 запросов и разбивайте результат по сценариям. Иначе средняя цифра спрячeт реальные провалы.

Как выбрать черновую модель?

Берите не самую маленькую модель, а ту, что пишет в похожем стиле и порядке слов с основной. Часто лучше работают модели одного семейства или с близкими инструкциями. После выбора проверьте долю принятых токенов на ваших данных, а не на одном удачном примере.

Может ли эта схема ухудшить качество или увеличить стоимость?

Может, и это нужно проверять отдельно. Если черновая модель часто ошибается, большая модель тратит больше шагов на откат и исправление, а цена и задержка растут. Смотрите не только на скорость, но и на точность метки, полноту сводки или число верно заполненных полей.

Как безопасно запустить спекулятивное декодирование в рабочем сервисе?

Начните с одного сценария и задайте порог успеха заранее. Например, включайте режим только там, где ответы длиннее заданного порога, p95 реально падает, а качество не проседает. Если вы тестируете пары моделей через AI Router, удобно менять маршрутизацию на стороне шлюза и не трогать клиентский код.