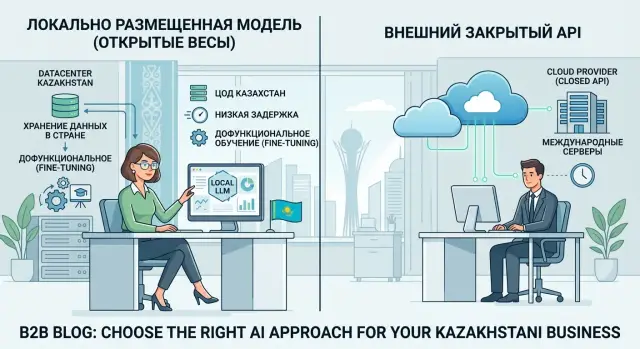

Модель с открытыми весами или закрытая: где что лучше

Модель с открытыми весами часто выигрывает там, где важны хранение данных в стране, низкая задержка и дообучение под свои процессы.

Почему выбор модели часто упирается не в качество ответа

На демо обычно побеждает модель, которая пишет чуть чище и увереннее. В рабочем сервисе этого мало. Команда почти всегда выбирает не самый "умный" ответ, а лучший баланс риска, цены и времени отклика.

Если оператор, клиент или сотрудник ждет 4 секунды вместо 700 миллисекунд, это заметно сразу. Если стоимость запроса на большом объеме внезапно вырастает вдвое, проблема тоже быстро становится реальной. Даже сильный результат на бенчмарке не спасает продукт, если ответы приходят поздно или бюджет уходит слишком высоко.

Сравнивать модели лучше не по красивому скриншоту и не по одному удачному промпту. Нужен обычный рабочий сценарий: реальный объем текста, ваши поля, ваши ограничения и пики нагрузки. Именно на таком тесте часто видно, что закрытый API дает хороший ответ, но начинает тормозить на длинных запросах, а более простая модель держит темп и стоит заметно дешевле.

Есть и еще один слой, о котором на демо часто забывают: где живут данные и логи. Для команд из Казахстана и Центральной Азии это не формальность. Если запросы, вложения или аудит-логи уходят за пределы страны, запуск может остановиться на проверке безопасности и комплаенса, даже если качество ответа всех устраивает.

Поэтому модель с открытыми весами иногда выигрывает у сильной закрытой не потому, что лучше пишет, а потому, что лучше вписывается в реальную работу. Она может отвечать быстрее, держать данные внутри страны и давать больше контроля над расходами. В продакшене это часто важнее, чем еще пара баллов в тестах.

Где закрытый API начинает мешать

Закрытый API удобен, пока команда проверяет идею на чистых и обезличенных данных. Проблемы начинаются в продакшене, когда в запросах появляются персональные данные, номера договоров, медицинские записи или внутренняя переписка.

Первый стоп-фактор - данные и логи уходят за пределы страны. Для банка, клиники или госкоманды это часто не вопрос удобства, а вопрос допуска. Даже если модель отвечает хорошо, юристы и ИБ могут просто не пустить такой сценарий в работу.

Вторая проблема - задержка. Запрос уходит во внешний контур, проходит через сеть провайдера и возвращается назад. Для редкого текстового запроса это терпимо, но в чате с оператором, голосовом боте или подсказках внутри CRM лишние сотни миллисекунд уже заметны. Разговор рвется, сотрудник ждет, клиент раздражается.

Есть и более тихий риск: команда живет по чужим правилам. Провайдер меняет лимиты, обновляет модель, двигает цены или закрывает часть функций. Код при этом может не меняться, а поведение модели уже другое.

Обычно это проявляется так: согласование с ИБ тянется неделями, пользователи замечают паузы в ответах, после обновления меняется стиль или точность, а сотрудники снова переписывают промпты под внутренние термины.

Есть и еще одно ограничение. Закрытый API обычно неплохо знает общий язык, но часто путается в ваших сокращениях, кодах статусов, названиях продуктов и шаблонах документов. Если провайдер не дает удобное дообучение или такие данные нельзя выносить наружу, качество быстро упирается в потолок.

В этот момент модель с открытыми весами уже не выглядит сложной экзотикой. Она дает больше контроля там, где важны локальное хранение, низкая задержка и точное знание вашего домена.

Когда открытые веса дают больше пользы

Открытые веса выигрывают не всегда. Но в рабочих задачах они часто удобнее закрытого API, если команде нужен контроль, а не только лучший ответ в общем тесте.

Первый тип задач - когда модель нужно держать рядом с данными. Если документы, переписка и заявки уже лежат во внутреннем контуре, локальный запуск убирает лишнюю передачу данных наружу. Это снижает риск, упрощает согласование с безопасностью и дает больше свободы в настройке.

Второй случай - когда важна быстрая реакция. В чате разница даже в секунду уже заметна. В голосовом сценарии она раздражает еще сильнее: человек делает паузу, перебивает систему или думает, что она зависла. Когда команда запускает модель ближе к пользователю, задержка обычно ниже и ответ приходит ровнее.

Третий случай - когда модель нужно подстроить под свой язык работы. Закрытый API может хорошо писать общий текст, но хуже понимает внутренние коды, формы, сокращения и типовые документы компании. Дообученная версия на открытых весах чаще отвечает точнее в узком процессе. Например, помощник для службы поддержки быстрее различает статусы заявки и не путает названия внутренних тарифов.

Есть и простая экономическая причина. При стабильной нагрузке расходы на модель с открытыми весами обычно легче считать. Команда понимает, сколько стоит инфраструктура, сколько запросов проходит в час и где предел по нагрузке. У закрытого API счет может заметно прыгать из-за объема токенов, выбора модели и внешних лимитов.

Если у вас постоянный поток запросов, строгие правила по данным и узкая предметная область, открытые веса часто дают больше пользы, чем внешний API.

Что меняется, если команда хранит данные в стране

Когда промпты, файлы и логи остаются внутри страны, меняется не только место хранения. Меняется сам риск проекта. Команде проще объяснить, куда уходят данные, кто к ним имеет доступ и как проходит удаление.

Для банка, телеком-команды или госорганизации это часто снимает самый болезненный вопрос: можно ли вообще запускать пилот на реальных рабочих данных. Если данные не уходят за рубеж, согласование с безопасностью и юристами обычно идет ровнее. Им не нужно разбирать длинную цепочку внешних подрядчиков и исключений.

Локальное размещение дает и более понятный контур работы. Внутри страны можно хранить не только ответы модели, но и весь служебный след: исходные промпты, вложения, логи запросов, метки доступа и историю изменений.

На практике это упрощает четыре вещи: маршрут данных легче описать для внутренней проверки, маскирование PII проще встроить до отправки запроса в модель, аудит-логи можно вести по ключу, команде или сервису, а споров о том, можно ли использовать рабочие документы в пилоте, становится меньше.

Разница особенно заметна, когда проект выходит за пределы демо. Пока команда тестирует модель на обезличенных примерах, почти любой закрытый API выглядит удобным. Но как только в процесс попадают обращения клиентов, договоры, медицинские записи или внутренние письма, вопрос "где лежат данные" становится важнее пары процентов в качестве ответа.

Хороший пример - внутренний помощник для контакт-центра банка. Если сервис работает через внешний API за пределами страны, каждый новый тип данных вызывает лишние проверки. Если та же схема держит промпты и логи локально, а PII маскируется до обработки, пилот обсуждать намного проще.

Для таких сценариев некоторые команды используют локальный хостинг или шлюз вроде AI Router. У него есть размещение open-weight моделей в Казахстане, маскирование PII и аудит-логи, что помогает там, где без локального контура проект просто не пропускают.

Где низкая задержка реально важна

Задержка заметна не в тестах, а в живой работе. Если оператор ждет ответ 4 секунды на каждый запрос, он быстро перестает пользоваться подсказками модели и возвращается к ручным действиям.

В чате внутри приложения темп еще важнее. Пользователь задает вопрос, видит паузу, потом еще одну, и диалог теряет ритм. Даже хороший ответ уже не кажется полезным, если приходит слишком поздно. Быстрый короткий отклик часто снижает число брошенных сессий лучше, чем небольшой прирост качества самой модели.

Часто время уходит не только на генерацию. Его съедает дорога запроса: внешний API в другом регионе, лишний сетевой круг, очереди у провайдера. Когда команда держит модель ближе к приложению, этот слой исчезает. Поэтому модель с открытыми весами иногда выигрывает у закрытого API: ответ может быть чуть проще, но он приходит вовремя.

Низкая задержка особенно важна в помощнике оператора во время звонка, в чате мобильного приложения, в поиске по внутренней базе, когда модель вызывают много раз за одну сессию, и в голосовых сценариях, где длинная пауза звучит как сбой.

Если команде нужен такой режим, локальный хостинг дает больше контроля. На своей инфраструктуре или через AI Router можно держать модель рядом с данными и сервисами, а не отправлять каждый запрос во внешний контур. Для задач, где важен темп диалога, это часто важнее, чем разница в качестве ответа на бенчмарке.

Зачем дообучать модель под свой процесс

Дообучение имеет смысл там, где модель каждый день решает одну и ту же рабочую задачу. Общая модель может писать неплохо, но часто путается во внутренних названиях, статусах и правилах ответа. Для бизнеса это не мелочь: одна неточная формулировка в заявке, чате или карточке клиента быстро превращается в ручные правки.

Хороший пример - внутренний помощник для сотрудников. Если у компании есть продукты с похожими названиями, свои этапы проверки и короткие служебные статусы, модель без дообучения начинает угадывать. Она может спутать тип заявки, назвать старую форму или ответить слишком общими словами. После настройки она уже знает ваш словарь и меньше ошибается на простых, но частых запросах.

Еще один плюс - можно заметно сократить системный промпт. Без дообучения команды часто кладут в него все сразу: стиль ответа, список продуктов, правила эскалации, формат текста и запреты на лишние фразы. Такой промпт разрастается, ответы становятся медленнее, а поведение модели все равно плавает. Дообученная модель держит базовые правила внутри себя, поэтому в промпте остается только задача и свежий контекст.

Обычно дообучение нужно, когда модель должна различать ваши продукты, тарифы и внутренние статусы, отвечать в одном тоне во всех каналах, соблюдать точный формат для формы, CRM или JSON и быстро перестраиваться после смены правил и шаблонов.

Именно здесь открытые веса часто оказываются удобнее внешнего API. Такую модель проще подстроить под процесс и обновлять тогда, когда это нужно вашей команде, а не вендору. Если компания работает с локальной инфраструктурой или через AI Router, где есть open-weight модели и варианты для fine-tuning, этот путь еще и снимает часть проблем с хранением данных и скоростью отклика.

Когда юристы меняют текст согласия или операционный отдел вводит новый статус, команда может обновить датасет и перевыпустить модель. Это обычно надежнее, чем каждый раз переписывать длинный промпт и надеяться, что модель запомнит новое правило.

Как принять решение без долгого пилота

Таблица с бенчмарками почти всегда врет для продакшена. Чтобы выбрать между закрытым API и вариантом, где модель с открытыми весами работает у вас или у локального провайдера, часто хватает короткой проверки на реальных задачах.

Возьмите не абстрактные промпты, а 3-5 живых сценариев. Лучше те, которые уже создают нагрузку бизнесу: ответ клиенту, разбор документа, поиск по базе знаний, краткая сводка по звонку. Один удачный демо-запрос почти ничего не доказывает.

Дальше прогоните реальные входы целиком: с системным промптом, историей диалога и обычным объемом текста. Замерьте задержку от действия пользователя до финального ответа, а не только скорость генерации. Разница между 0,8 и 3 секундами сильно меняет опыт в чате и операторском окне.

Сразу отметьте поля, которые нельзя отправлять за рубеж: ИИН, номер счета, телефон, медицинские данные, внутренние документы. После этого часть вариантов отпадет сама. Затем посчитайте цену на тысячу реальных запросов с длинным контекстом, повторными вызовами и ретраями. И отдельно решите, нужен ли вам контроль над версией модели. Если процесс завязан на стабильный формат ответа, неожиданное обновление у внешнего API может сломать поток за один день.

Такой тест можно провести за несколько дней, а не за месяцы. Если нужен единый OpenAI-совместимый шлюз, AI Router позволяет прогонять один и тот же набор запросов через разные модели, меняя только base_url, а затем сравнивать качество, задержку, цену и ограничения по данным без переделки кода.

После такой проверки выбор становится намного проще. Если одна модель чуть умнее, но проигрывает по задержке, цене или правилам хранения данных, решение уже не выглядит теоретическим. Оно становится рабочим.

Пример: помощник для банка

В банке такой помощник обычно нужен не клиенту, а сотруднику. Оператор, юрист или специалист бэк-офиса каждый день ищет ответы в регламентах, тарифах, шаблонах писем и внутренних инструкциях. Если поиск занимает 7-10 минут на один вопрос, очередь растет очень быстро.

Проблема в том, что запросы редко бывают "чистыми". В них почти всегда есть ФИО, ИИН, номер договора, остаток по счету или текст обращения клиента. Отправлять такие данные во внешний API многим банкам неудобно уже на уровне правил безопасности. Даже если ответ у внешней модели сильный, риск и согласования съедают выгоду.

В таком сценарии модель с открытыми весами часто дает больше пользы. Ее можно запустить локально, оставить данные внутри страны и добавить маскирование PII до того, как запрос попадет в модель. Сотрудник пишет вопрос в обычной форме, а система скрывает чувствительные поля и сохраняет только нужный контекст. Риск ниже, а процесс не ломается.

Еще один плюс дает дообучение под внутренний язык банка. Без него помощник отвечает слишком общо или путает формулировки из разных регламентов. После настройки он чаще использует нужные шаблоны, правильные названия продуктов и привычный стиль ответа. У сотрудника уходит меньше времени на ручные правки перед отправкой клиенту или коллегам.

Спорные ответы тоже проще разбирать, если система ведет аудит-логи. Руководитель видит, какой вопрос задал сотрудник, какой документ попал в контекст, что именно ответила модель и где она ошиблась. Это полезно и для контроля, и для доработки промптов, правил маскирования и набора документов.

Частые ошибки при выборе

Команды часто выбирают модель по красивому демо или по месту в общем рейтинге. Это почти всегда уводит в сторону. Если реальный поток состоит из коротких запросов, внутренних терминов, таблиц и диалогов на русском и казахском, смотреть нужно не на чужие тесты, а на свои 50-100 типовых кейсов.

Вторая частая ошибка - считать только цену токена. Дешевый токен не спасает, если модель отвечает медленно, просит длинный контекст, часто ошибается в извлечении полей или требует повторных вызовов. В продакшене деньги уходят не только на генерацию, но и на ретраи, ручные проверки, поддержку и простои команды.

Часто проблемы начинаются в четырех местах. Берут публичный бенчмарк вместо своих диалогов, писем и документов. Готовят датасет для дообучения без очистки и оставляют персональные данные, дубли и шум. Пытаются посадить все сценарии на одну модель, хотя классификация, поиск по базе знаний и чат с клиентом требуют разного поведения. И запускают доступ без лимитов по ключам и без нормального журнала действий, а потом не понимают, кто сжег бюджет и где сломался поток.

Особенно дорого обходится грязный датасет для дообучения. Команда ждет, что модель начнет лучше понимать внутренний язык, а получает старые ошибки в новой упаковке. Если в примерах много дублей, противоречий и лишних персональных данных, модель запоминает шум вместе с полезными правилами.

Быстрая проверка перед запуском

Ошибку в выборе модели обычно видно не на демо, а после первой рабочей нагрузки. Если команда ответит на несколько простых вопросов заранее, она сэкономит недели на переделке интеграции, согласованиях и лишних расходах.

- Если пользователь ждет ответ дольше 1-2 секунд, сценарий ломается или просто начинает раздражать?

- Нужно ли хранить данные в стране, включая промпты, логи и персональные поля?

- Есть ли у вас хотя бы несколько сотен хороших примеров для дообучения одного процесса?

- Стала ли нагрузка такой, что вы уже платите за токены каждый день и в заметном объеме?

- Сможете ли вы сменить модель за день, а не за месяц?

Если хотя бы на два вопроса ответ "да", не смотрите только на качество ответа в вакууме. Сравните схему целиком: где живут данные, какой отклик держится под нагрузкой, можно ли дообучить модель и как быстро команда заменит провайдера.

Для таких случаев открытые веса часто оказываются полезнее, чем кажется на старте. А если команда использует OpenAI-совместимый шлюз, она может менять провайдера или перейти на свой хостинг без переписывания SDK, кода и промптов.

Что делать дальше

Не пытайтесь решить все сразу. Возьмите один сценарий, где ошибка дорого стоит: ответ клиенту, проверка заявки, подсказка оператору или поиск по внутренним документам. На таком примере разница между закрытым API и своей моделью видна быстро, без пилота на полгода.

Дальше лучше идти по простому плану. Соберите набор из 50-100 реальных запросов и добавьте туда не только обычные случаи, но и сложные: длинные документы, неоднозначные формулировки, чувствительные данные. Прогоните этот набор через внешнюю модель и через модель с открытыми весами. Смотрите не только на качество ответа, но и на задержку, цену одного запроса, стабильность и маршрут данных.

Еще один практичный шаг - не вшивать выбор модели прямо в приложение. Оставьте единый API-слой между продуктом и моделями, чтобы потом менять маршрут, провайдера и правила без переделки кода. Это избавляет от лишней жесткости и дает больше свободы, когда требования меняются уже после запуска.

Иногда итог оказывается смешанным. Для общего текста команда оставляет внешний API, а для чувствительных или частых задач берет модель с открытыми весами на локальном хостинге. На практике это обычно разумнее, чем искать одну идеальную модель для всего сразу.

Часто задаваемые вопросы

Что важнее при выборе модели: качество ответа или скорость?

Сначала смотрите на сценарий. Если человек ждет ответ в чате, в голосе или в окне оператора, задержка и цена часто влияют сильнее, чем чуть более красивый текст. Модель с лучшим ответом на демо легко проигрывает в работе, если отвечает медленно или слишком дорого стоит на большом объеме.

Когда закрытый API уже мешает работе?

Проблемы обычно начинаются там, где в запросах есть персональные данные, внутренние документы или строгие правила по логам. Снаружи сервис может работать хорошо, но юристы и ИБ часто останавливают запуск, если данные уходят за пределы страны. Вторая частая причина — лишняя задержка на каждом запросе.

Зачем хранить промпты и логи внутри страны?

Потому что так команде проще объяснить маршрут данных, доступы и удаление. Для банка, клиники или госкоманды это часто снимает спор еще до пилота. Когда промпты, файлы и аудит-логи лежат локально, согласование идет ровнее и проект реже упирается в проверки.

В каких задачах открытые веса чаще выигрывают?

Они хорошо подходят для задач с постоянной нагрузкой, узким словарем и жесткими требованиями к данным. Если модель должна сидеть рядом с документами, быстро отвечать и понимать внутренние коды, локальный вариант часто дает больше пользы, чем внешний API. Особенно это заметно в поддержке, контакт-центре и внутренних помощниках.

Когда уже пора дообучать модель под свой процесс?

Дообучение нужно, когда модель каждый день решает один и тот же процесс и регулярно путает ваши названия, статусы или формат ответа. После настройки она лучше держит словарь компании и реже требует длинный системный промпт. Это удобно для CRM, заявок, регламентов и шаблонных ответов сотрудникам.

Открытые веса всегда дешевле закрытого API?

Не всегда. На малом объеме внешний API часто проще и дешевле для старта. Но при стабильной нагрузке свои мощности легче считать: команда видит цену инфраструктуры, предел по запросам и не зависит от чужих лимитов и скачков счета за токены.

Как быстро сравнить две модели без пилота на месяцы?

Возьмите 50–100 реальных запросов, а не абстрактные примеры. Прогоните их через оба варианта с тем же системным промптом, историей и обычной длиной контекста. Потом сравните четыре вещи: качество, задержку, цену одного запроса и маршрут данных. На это часто хватает нескольких дней.

Можно ли использовать закрытый API и локальную модель вместе?

Да, и это часто самый разумный путь. Общие тексты можно оставить на внешнем API, а чувствительные или частые задачи перевести на локальную модель. Так команда не ищет один вариант для всего и держит баланс между качеством, скоростью и правилами по данным.

Какие ошибки команды делают чаще всего при выборе модели?

Чаще всего команды смотрят на красивое демо, считают только цену токена и берут один вариант для всех задач. Еще одна частая ошибка — грязный датасет для дообучения с дублями, шумом и персональными данными. После такого модель учит чужие ошибки вместо ваших правил.

Зачем ставить единый API-слой между продуктом и моделями?

Он дает свободу на будущее. Если вы держите один OpenAI-совместимый слой между приложением и моделями, команда может менять провайдера, маршрут или тип модели без переделки SDK и промптов. Для таких задач подходит и AI Router: можно менять base_url и сравнивать разные модели в одном контуре.