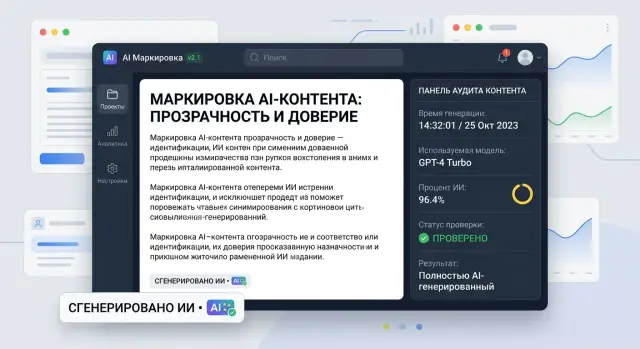

Метки AI-контента в продукте: где ставить и что хранить

Метки AI-контента в продукте помогают честно показать источник текста, сохранить следы генерации и не перегрузить экран лишними деталями.

Почему без маркировки возникает путаница

Когда AI пишет текст, а интерфейс этого не показывает, пользователь делает простой вывод: ответ написал человек или компания вручную утвердила каждую фразу. Поэтому любая ошибка выглядит не как промах модели, а как официальный ответ продукта.

Представьте чат в приложении. Человек спрашивает про возврат, лимит или условия услуги. Если рядом нет ясной метки, он не понимает, что перед ним: сгенерированный ответ, шаблон или сообщение сотрудника. Он копирует текст, спорит с поддержкой и ссылается на "ваш ответ". Для него это вполне логично.

Из-за этого быстро растет цена даже маленькой ошибки. Поддержка тратит время на спорный кейс, потому что сначала нужно понять, кто вообще написал текст. Юристы и комплаенс просят показать источник ответа и его статус. Команда продукта ищет нужную генерацию среди логов, версий и правок.

Самая неприятная часть в том, что спор часто начинается из-за мелочи. Модель выбрала слишком уверенный тон, пропустила оговорку или смешала старые и новые данные. Без маркировки это выглядит как обычный текст интерфейса. Пользователь не видит границу между "сгенерировано" и "проверено".

Для компаний с высокими требованиями к аудиту это особенно заметно. В банке, телекоме или госсекторе мало просто ответить клиенту. Потом еще нужно доказать, откуда взялся текст, какая система его создала и почему он попал в интерфейс. Если метки нет, каждый такой вопрос превращается в ручное расследование.

Есть и внутренняя цена. Один человек ищет диалог, другой пытается понять версию промпта, третий сверяет модель и время ответа. Сам инцидент может быть небольшим, но разбор тянется часами, потому что команда не может быстро отделить AI-ответ от обычного текста.

Четкая метка не исправляет качество сама по себе. Она делает другое: сразу объясняет происхождение ответа и снижает ложные ожидания. Это простой шаг, который экономит время пользователю, поддержке и тем, кто потом проверяет спорные случаи.

Где ставить метку в интерфейсе

Метка должна стоять там, где человек читает, копирует, отправляет или утверждает результат. Если пользователь видит ответ, но не видит, что его сгенерировала модель, он легко примет черновик за финальный текст. Именно в этот момент и начинается путаница.

Удачная маркировка не прячется в футере, справке или мелкой подсказке по иконке. Пользователь редко ищет источник текста специально. Он смотрит на сам блок с контентом, и маркировка должна быть рядом.

В чате метку лучше ставить прямо возле ответа модели или сразу под ним. Не в верхней панели экрана и не в настройках. Если человек листает длинный диалог, у каждого AI-ответа должен быть свой заметный знак. Иначе через пять сообщений уже непонятно, где писал оператор, а где модель.

В формах и редакторах логика та же. Если система создала черновик письма, описание товара или служебную заметку, подпись "Сгенерировано AI" лучше показать сразу под текстом или над полем редактирования. Когда пользователь начинает править текст вручную, статус стоит обновить. Например: сначала "Черновик от AI", потом "Изменено человеком".

С документами часто ошибаются в одном и том же месте: метка видна только в редакторе, но исчезает из истории изменений. Это плохой вариант. Если AI добавил абзац в договор, комментарий в CRM или новую версию внутреннего документа, отметка должна остаться в журнале правок. Тогда команда видит не только итог, но и происхождение фрагмента.

Отдельно проверьте экспорт. Если пользователь отправляет материал по почте, выгружает его в PDF или передает в другой отдел, маркировка не должна пропадать по дороге. Иначе внутри интерфейса у вас "текст от AI", а снаружи это уже обычный документ без следов происхождения.

Простое правило такое: метка должна быть рядом с ответом в чате, рядом с AI-черновиком в форме или редакторе, в истории изменений и версиях документа, а также в письме, PDF и другом экспорте.

Даже если запросы идут через единый AI-шлюз и на бэкенде есть логи, этого мало. Пользователь должен видеть маркировку в самом интерфейсе в тот момент, когда он решает: читать, править, согласовывать или отправлять текст дальше.

Что писать рядом с меткой

Одна метка без пояснения редко помогает. Пользователь видит "AI" и не понимает главное: это сырой черновик, текст после проверки или уже финальная версия. Короткая подпись рядом с меткой убирает путаницу быстрее, чем длинная справка.

Лучше писать простыми словами. Человек должен понять смысл за секунду, без юридического тона и без формулировок из регламента.

Подходят короткие варианты вроде "Черновик от AI", "Сгенерировано AI", "Проверено сотрудником", "Опубликовано после проверки" или "Ответ подготовил AI, проверьте перед отправкой".

Важно не смешивать разные статусы в одну фразу. "Сгенерировано AI" говорит о происхождении текста. "Проверено человеком" показывает, что кто-то его просмотрел. "Опубликовано" или "Отправлено" относится уже к этапу процесса. Если склеить это в одну надпись, она станет нечитаемой.

Хорошая схема простая: сначала источник, потом статус. Например, в интерфейсе поддержки можно показать "Черновик от AI" рядом с кнопкой редактирования. После просмотра оператором текст меняется на "Проверено сотрудником". Когда ответ ушел клиенту, система показывает уже статус отправки, а не повторяет всю историю генерации на экране.

Время генерации стоит показывать только там, где оно влияет на решение. Это полезно в сводках, ценах, новостях, ответах поддержки и в любом контенте, который быстро устаревает. Подпись вроде "Сгенерировано в 10:42" или "Обновлено AI 5 минут назад" помогает понять свежесть текста. Если время ничего не меняет, лучше не добавлять его ради галочки. Лишние цифры создают шум.

Название модели тоже нужно не везде. На клиентском экране оно чаще мешает, чем помогает. Пользователю обычно все равно, какая именно модель написала черновик. Ему важнее знать, можно ли опираться на текст и нужна ли проверка.

Модель стоит показывать во внутренних интерфейсах, где команда следит за качеством, стоимостью или аудитом генерации. В таких случаях можно хранить модель и провайдера в деталях записи, а рядом с текстом оставить только понятную метку.

Полезно добавить короткое объяснение, зачем эта метка вообще стоит. Одного предложения достаточно: "Этот текст создала модель, сотрудник может его изменить". Если подпись не отвечает на вопрос "что мне делать с этим текстом", ее лучше переписать.

Какие следы генерации хранить

Маркировка полезна только тогда, когда за ней есть понятный след действий. Если ответ, описание товара или письмо создала модель, потом кто-то все равно спросит: откуда это взялось, кто это запустил и что изменили после.

Начните с самой простой связки: ID документа, ID сессии и ID пользователя. Этого уже хватает, чтобы привязать генерацию к конкретному объекту в системе, к сценарию использования и к человеку, который отправил запрос. Без этой тройки лог быстро превращается в набор событий, которые ни с чем нельзя связать.

Дальше сохраните "рецепт" генерации: версию промпта и версию шаблона, если вы собираете запрос из нескольких блоков. Через несколько дней текст может отличаться не из-за модели, а из-за одной правки в шаблоне. Если версий нет, спорить придется вслепую.

Отдельно фиксируйте параметры вызова. Обычно хватает названия модели, провайдера, температуры, лимита токенов, времени отправки запроса и времени ответа. Если система умеет отправлять запросы разными маршрутами, стоит записывать и фактический маршрут.

Минимум для аудита

- ID документа, сессии и пользователя

- версия промпта и шаблона

- модель, параметры и время ответа

- очищенные входные данные

- след ручных правок после генерации

Со входными данными нужна аккуратность. Храните только то, что помогает проверить результат или повторить запрос. Если в исходном тексте есть персональные данные, лучше маскировать их до записи в лог или сохранять сокращенный фрагмент. Полная копия всего ввода "на всякий случай" часто создает лишний риск и редко помогает так сильно, как кажется.

Не забывайте про этап после ответа модели. Важно отмечать, кто принял результат, кто его правил и насколько сильно текст изменился. На старте не нужно строить сложное построчное сравнение. Обычно хватает статусов "сгенерировано", "отредактировано" и "утверждено" плюс истории версий.

Обычный пример - черновик ответа для поддержки. Клиент жалуется на неточную формулировку, и команда поднимает цепочку за пару минут: какой сотрудник запустил генерацию, какой шаблон использовали, какая модель вернула текст, сколько занял ответ и что потом исправил человек. Такой аудит помогает не искать виноватого, а быстро найти причину и поправить процесс.

Как внедрить это по шагам

Начните с карты всех мест, где модель что-то пишет, меняет или дополняет. Обычно таких точек больше, чем кажется: ответы в чате, черновики писем, резюме документов, подсказки оператору, переписанные заголовки, автозаполнение полей. Пока этой карты нет, метки появляются случайно: в одном экране они есть, в другом нет, а в логах потом пусто.

Затем соберите все сценарии генерации в одну таблицу. Для каждого экрана зафиксируйте, кто видит результат, может ли он принять его за финальный текст и влияет ли этот текст на деньги, договор, заявку или решение сотрудника. Уже на этом шаге становится понятно, где нужна заметная метка в интерфейсе, а где достаточно лога.

После этого опишите единый формат события генерации. Храните ID объекта, поле или блок, время, пользователя или сотрудника, модель, версию шаблона, входные данные или их хэш, результат или его хэш и текущий статус проверки. На практике чаще всего ломается именно этот шаг. Команды быстро рисуют метку в интерфейсе, но по-разному пишут события в бэкенд. Через месяц уже нельзя нормально отфильтровать генерации по модели, отделу или статусу.

Дальше добавьте статусы после ручной правки. Простая схема работает лучше сложной: "создано моделью", "изменено человеком", "проверено человеком". Тогда команда не путает сырой ответ модели с текстом, который уже просмотрел редактор, оператор или юрист.

И в конце проверьте, как все это живет вне интерфейса. Поиск, экспорт, история изменений и аудит должны показывать не только финальный текст, но и путь к нему: что сгенерировала модель, кто исправил, когда утвердили.

Если продукт работает в банке, телекоме или госсервисе, не откладывайте аудит на потом. Сначала введите одну схему событий и три понятных статуса, а потом раскатывайте ее на новые экраны. Так проще и пройти проверку, и быстро разобрать спорный случай, когда пользователь спрашивает, откуда взялся этот текст.

Пример на простом сценарии

Оператор поддержки получает вопрос клиента: "Почему списалась двойная сумма?" Он нажимает кнопку генерации, и AI предлагает черновик ответа на основе карточки заказа и правил возврата. Метка нужна уже в этот момент, а не после отправки.

Над сгенерированным текстом система сразу показывает короткую пометку: "Черновик создан AI". Она стоит прямо над полем ответа, а не где-то внизу экрана. Оператор видит статус сразу и не путает черновик с готовым сообщением.

Текст может быть таким: "Мы видим повторное списание. Проверим платеж и вернем лишнюю сумму в течение 3 рабочих дней". Оператор читает ответ, убирает неточную фразу про срок, добавляет номер заявки и меняет статус на "Проверено сотрудником". После этого интерфейс уже не должен показывать тот же статус, что и у сырого черновика.

В логе система хранит не весь шум вокруг генерации, а только то, что потом поможет понять источник ответа: текст промпта, идентификатор модели, время генерации, исходный AI-черновик и финальный текст после правок.

Теперь представим жалобу. Клиент пишет, что компания "обещала возврат за 3 дня", но деньги не пришли. Команда поддержки открывает историю и за минуту видит цепочку: оператор запросил черновик в 14:03, модель вернула текст с этим сроком, сотрудник оставил фразу без правки и отправил ответ в 14:05.

Такая история убирает догадки. Руководитель понимает, ошиблась модель или сотрудник, юрист видит точный текст, который ушел клиенту, а продуктовая команда решает, что именно исправить: промпт, шаблон или саму маркировку в интерфейсе.

Если убрать метку или не хранить следы генерации, спор быстро превращается в "мы не знаем, откуда это взялось". В поддержке это плохой сценарий. Людям нужен не только быстрый AI-ответ, но и понятная история его появления.

Где UX ломается чаще всего

Проблемы начинаются не там, где команда добавила метку, а там, где пользователь перестал понимать, что перед ним. Маркировку часто делают формально: значок есть, смысла нет. В итоге люди или не замечают пометку, или читают ее слишком поздно.

Частая ошибка - ставить метку прямо поверх текста, карточки или превью. Она закрывает первые слова, сбивает ритм чтения и раздражает сильнее, чем помогает. Если человек пришел за ответом, он должен сначала видеть сам контент, а уже рядом - его статус.

Другая крайность - делать метку настолько тихой, что ее никто не замечает. Серый мелкий шрифт в углу выглядит аккуратно только на макете. В реальном интерфейсе он теряется среди кнопок, дат и служебных подписей. Если маркировка нужна для прозрачности, ее должно быть видно без усилий.

Путаница почти всегда возникает в одних и тех же местах. Одинаковая метка стоит на черновике и на тексте, который уже проверил сотрудник. Знак есть в интерфейсе, но пропадает после копирования в письмо, чат или документ. Пользователь видит "AI", но не понимает, что это значит: текст полностью сгенерирован, слегка отредактирован или только предложен как вариант. Еще один частый сбой - метка живет отдельно от действия: человек нажал "Отправить", а статус текста так и остался неясным.

Одинаковая маркировка для разных состояний быстро ломает доверие. Черновик, который модель написала сама, и ответ, который менеджер переписал вручную, нельзя помечать одинаково. Иначе пользователь не понимает, где еще нужна проверка, а где за текст уже отвечает человек.

Хороший тест очень простой. Сотрудник поддержки генерирует ответ клиенту, правит два абзаца и копирует текст в письмо. Если метка исчезла, получатель решит, что письмо написал человек с нуля. Если метка осталась, но выглядит как случайный ярлык, она тоже не поможет.

Нормальный UX дает ясность за несколько секунд. Пользователь сразу видит статус текста, не теряет его при экспорте и понимает, что именно сделал AI, а что сделал человек. Если этого нет, маркировка мешает больше, чем помогает.

Быстрая проверка перед релизом

Перед запуском лучше поймать мелкие сбои, которые потом раздражают пользователей и ломают аудит. Обычно проблема не в самой метке, а в деталях: на десктопе ее видно, а на телефоне она уезжает под меню; в интерфейсе все честно подписано, а в экспорте и API следов уже нет.

Хороший тест - пройти один простой сценарий целиком. Пользователь создает документ с помощью AI, правит текст вручную, сохраняет, экспортирует файл, а потом команда поддержки ищет это событие в логе. Если на любом шаге цепочка рвется, релиз еще сырой.

Проверьте несколько вещей. На мобильном экране метка должна быть видна без лишних нажатий и не прятаться за иконками, табами или липкой шапкой. После ручного редактирования лог не должен исчезать: система хранит факт генерации, время, модель и версию документа. Сотрудник поддержки или аудитор должен находить событие по ID документа за пару секунд, без ручного перебора записей. Маркировка должна уходить дальше интерфейса - в экспорт, webhook, API-ответ или другой канал, где этот контент живет после создания. И еще один практический момент: логи не должны тащить лишние персональные данные. Если для проверки хватает ID, типа события и времени, не храните полный текст и PII без причины.

Особенно часто все ломается после редактирования. Команда добавляет метку только к первому черновику, а после сохранения новой версии система уже считает документ "обычным". Это плохой вариант. Пользователь видит финальный текст, а служба комплаенса потом не может доказать, где началась генерация и кто внес правки.

Полезно задать себе один жесткий вопрос: сможет ли другой сотрудник, который не участвовал в разработке, за минуту понять историю документа? Если нет, лог слишком слабый или интерфейс слишком запутанный.

Что сделать после запуска

После релиза работа только начинается. В первый месяц обычно всплывают не баги, а спорные случаи: пользователь увидел метку, но понял ее не так; менеджер посчитал текст готовым, хотя система считала его черновиком; поддержка не смогла быстро восстановить цепочку действий.

Собирайте такие эпизоды в одном месте. Не просто тикеты, а короткие разборы: что человек хотел сделать, что увидел на экране, какой текст ушел дальше и какая метка была в этот момент. Уже через две-три недели станет видно, где маркировка работает, а где люди читают ее по-своему.

Отдельно проверьте путаницу между черновиком и готовым текстом. Это частая проблема. Пользователь может открыть подсказку от модели, немного ее поправить и решить, что документ уже согласован системой или человеком. Если такое случается, смотрите не только на слова рядом с меткой, но и на весь путь текста: что видно в редакторе, что видно после сохранения, что попадает в экспорт, карточку клиента или историю изменений.

Нужны и живые данные, и нормальный аудит генерации. Обычно хватает простого набора: кто запустил генерацию и в каком контексте, когда это произошло, какая модель или провайдер ответили, какая версия метки и правил показа действовала, а также редактировал ли человек результат после ответа модели.

Срок хранения логов почти всегда приходится менять после запуска. На старте команды часто ставят срок "с запасом" или, наоборот, слишком короткий период. Смотрите на реальные процессы: сколько времени поддержка разбирает жалобы, когда подключается комплаенс, как долго бизнес хранит спорные документы. Часто помогает разделение: полные тексты хранить меньше, а метаданные и историю статусов держать дольше.

Если команда строит продукт в Казахстане и использует единый OpenAI-совместимый шлюз, полезно сразу проверить не только вызовы моделей, но и метки контента, аудит-логи и маскирование PII. Например, AI Router позволяет оставить один API-эндпоинт и собрать такие инфраструктурные требования в одном месте, но логи и маршрутизация все равно не заменяют понятную маркировку в самом интерфейсе.

Хороший результат после первого месяца выглядит просто: поддержка быстрее разбирает спорные обращения, пользователи реже путают AI-черновик с готовым материалом, а команда понимает, какие логи действительно нужны, а какие только занимают место.

Часто задаваемые вопросы

Зачем вообще помечать AI-текст в продукте?

Без метки человек принимает текст за официальный ответ компании или за сообщение сотрудника. Тогда даже мелкая ошибка быстро превращается в спор: пользователь ссылается на текст, а команда тратит время на разбор.

Метка не лечит качество ответа, но сразу показывает происхождение текста и снижает ложные ожидания.

Где лучше показывать метку в интерфейсе?

Ставьте ее рядом с самим текстом в тот момент, когда человек читает, копирует, редактирует, согласует или отправляет результат. В чате это обычно блок ответа, в редакторе — поле с черновиком, в документе — история версий.

Не прячьте маркировку в футере, справке или настройках. Там ее почти никто не заметит.

Что написать рядом с меткой, чтобы было понятно?

Лучше писать простыми словами: Черновик от AI, Сгенерировано AI, Проверено сотрудником. Такие фразы человек понимает сразу.

Не смешивайте источник и этап процесса в одну длинную надпись. Сначала покажите, кто создал текст, потом — проверял ли его человек.

Нужно ли менять статус после ручной правки?

Да, иначе человек легко примет черновик за готовый ответ. Когда сотрудник изменил текст, обновите статус на что-то вроде Изменено человеком или Проверено сотрудником.

Одинаковая метка для сырого черновика и проверенного текста только добавляет путаницу.

Какие данные о генерации стоит хранить в логе?

Начните с простого набора: ID документа, ID сессии, ID пользователя, версию промпта или шаблона, модель, время запроса и исходный результат. Этого уже хватает, чтобы восстановить цепочку.

Потом добавьте финальный текст после правок и статус проверки. Так команда быстро поймет, что сделала модель, а что изменил человек.

Нужно ли показывать название модели пользователю?

Показывайте модель там, где команда следит за качеством, ценой и аудитом. Во внутренних экранах это полезно.

На клиентском экране название модели чаще мешает. Пользователю обычно важнее понять, можно ли доверять тексту и нужна ли проверка.

Что делать с меткой при экспорте в PDF, письмо или API?

Нет, не должна. Если метка остается только в редакторе, а в письме, PDF или другом канале исчезает, получатель видит обычный текст без истории происхождения.

Проверьте экспорт отдельно. Это частое место, где прозрачность ломается.

Как хранить логи и не собирать лишние персональные данные?

Не храните полный ввод без причины. Если в данных есть персональная информация, маскируйте ее до записи в лог или сохраняйте только нужный фрагмент.

Держите в логе только то, что помогает проверить ответ и повторить сценарий. Лишние данные создают риск и редко дают пользу.

Как быстро проверить маркировку перед релизом?

Пройдите один реальный сценарий от начала до конца. Пусть человек создаст текст через AI, отредактирует его, сохранит, экспортирует и попробует найти событие по ID в логе.

Отдельно проверьте мобильный экран, историю изменений и статусы после правки. Именно там чаще всего рвется цепочка.

Что стоит отслеживать после запуска?

Собирайте спорные случаи в одном месте и смотрите на них как на цепочку действий, а не как на отдельные тикеты. Полезно записывать, что человек увидел, какой статус был у текста и что ушло дальше.

Через несколько недель станет ясно, где метка работает, а где люди читают ее неправильно. После этого проще поправить слова, статусы и правила показа.