SDK-ны қайта жазбай LLM-ге көппровайдерлік қолжетімділік

LLM-ге көппровайдерлік қолжетімділік: бір эндпоинтті, ортақ аутентификацияны және резервтеуді SDK-ны ауыстырмай әрі кодқа артық логика қоспай қалай жинауға болатыны.

Бірнеше провайдермен жұмыс қай жерде бұзылады

Мәселе модельді таңдаған сәтте емес, интеграция кезінде басталады. Команда бір ғана провайдермен жұмыс істеп жүргенде, бір base_url-ға қатаң байлану ұсақ нәрсе сияқты көрінеді. Кейін екінші провайдер, қосалқы маршрут немесе жергілікті орналастырылған модель пайда болғанда, адрес, header, модель атауы және қате өңдеу ережелері әр сервисте шашылып жатқанын бірден байқайсыз.

Көбіне команда кодты бір API-ға тым ерте байлап қояды. SDK-лар бизнес-логиканың ішінде инициализацияланады, base_url әр сервистің конфигіне кіргізіледі, ал жауап форматы жалпы стандарт деп қабылданады. Соның салдарынан тіпті кіріс нүктесін қарапайым ауыстырудың өзі бірнеше репозиторийге түзету, жаңа environment айнымалылары және ұзақ тексеріс әкеледі. Продакшн үшін бұл — тиімсіз айырбас.

Келесі мәселе — аутентификация. Әр провайдердің өз кілттері, лимиттері және ережелері бар. Бір кілт batch тапсырмада тез таусылып, кенет support чаты құлап қалады. Бір провайдер лимитті токенмен есептейді, екіншісі минутына сұраныс санымен, үшіншісі трафикті IP бойынша шектейді. Егер ортақ қолжетімділік қабаты болмаса, ешкім толық картинаны көрмейді. Логтар әр жерде жатады, ал ақаудың себебі кездейсоқ сияқты көрінеді.

Сосын желілік қателер келеді. Бір провайдер қосылымды тым ұзақ ұстайды. Екіншісі 429-ды тез қайтарады. Үшіншісі екі минут бойы топтап 5xx береді. Егер қосымша timeout, қайта әрекет ету және запас маршрутқа ауысуды әртүрлі өңдесе, оғаш эффектілер басталады: сұраныс тұрып қалады, пайдаланушы батырманы қайта басады, жүйе дубликат жібереді, ал құн бекер өседі.

Осының бәрінде командалар көбіне бірдей обвязканы қайтадан жазады. Біреу retry қосады, біреу PII-ді жасырады, біреу құнды есептейді, біреу аудит-лог жүргізеді. Логикасы ұқсас, бірақ ұсақ-түйегі әртүрлі. Бірнеше айдан кейін LLM-ге көппровайдерлік қолжетімділік басқарылатын архитектураның орнына үйлеспейтін ережелер жиынына айналады.

Жақсы мысал — екі провайдері бар support чаты. Негізгі маршрут тез жұмыс істейді, ал қосалқысы тек 429 және 5xx кезінде керек. Қағаз жүзінде бәрі оңай. Іс жүзінде бір сервис тек бір эндпоинтті біледі, екіншісі кілттің басқа форматын қолданады, үшіншісі тіпті жаңа релизсіз ауыса алмайды. Апат кезінде бұл бірден көрінеді: сұраныстар тұрып қалады, лимиттер таусылады, ал әр команда өз бөлігін бөлек түзетеді.

Бірыңғай шлюз не істеуі керек

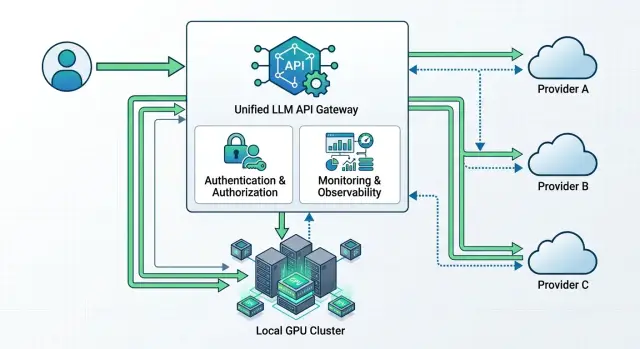

Бірыңғай шлюз бір сервис OpenAI-ға, екіншісі Anthropic-ке, үшіншісі жергілікті модельге өз клиенті арқылы қатынайтын кезде пайда болатын хаосты жояды. Ішкі қосымшалар бір LLM эндпоинтіне сұраныс жібереді де, бірдей жауап форматын алады. Жоғары деңгейдегі код бірден қарапайымырақ болады.

Әдетте мұндай шлюзді OpenAI-ге үйлесімді етіп жасайды. Сонда команда тек base_url мен токенді ауыстырады, ал SDK, промпттар және интеграцияның көп бөлігі өзгеріссіз қалады. Бұл — көппровайдерлік схемаға апаратын ең қысқа жол: түзету аз, релизден кейінгі күтпеген қателер аз.

Қалыпты шлюз бірнеше істі бірден атқарады. Ол чат, streaming және tools үшін бірыңғай сұраныс форматын қабылдайды, провайдерлердің айырмашылығын бір схемаға келтіреді, маршрутты ережелер жиыны бойынша таңдайды, кідіріс, ақау және шығын бойынша лог жинайды, әрі timeout, қайта әрекет ету және жиілік шектеулерін қолданады. Қажет болса, сол жерде PII-ді жасыру мен аудит те жүреді.

Мұндай схеманың өзегі — маршруттар кестесі. Онда әдетте модель алиасы, провайдерлер тізімі, таңдау реті, запас маршрут және бюджет шектеулері сақталады. Мысалы, support-chat маршруты алдымен күшті модельге барады да, кідіріс өссе немесе 429 шықса, қосымша өзгеріссіз екінші нұсқаға ауысады.

Ортақ сұраныс форматы көп ұсақ, бірақ жағымсыз проблеманы шешеді. Бір провайдерде өріс былай аталады, екіншісінде басқаша, үшіншісінде streaming немесе tools өзге тәсілмен жұмыс істейді. Шлюз бұл айырмашылықтарды тегістейді, сонда командаға әр API-дың жеке ережелерін есте сақтап жүрудің керегі жоқ.

Мұндай қабат логсыз іс жүзінде пайдасыз. Әр маршрут бойынша кідіріс, қате үлесі, токендер және құн туралы дерек керек. Сонда команда бүкіл сервис емес, нақты провайдер немесе жеке модель тежеп тұрғанын тез түсінеді.

Timeout пен қайта әрекет етуді де сценарийге қарай қойған дұрыс. Support чаты әдетте 2–4 секунд күте алады, ал batch өңдеу ұзақтау күте алады. Қайта тек желілік қателерді, 429 мен кейбір 5xx-ті сынаған жөн. Сыртқы әрекетті іске қосатын tools сұраныстарын қайталанудан қорғай алмай дублирлеу қауіпті.

Тәжірибеде мұндай қабатты жиі бөлек API-шлюзге шығарады. Осы схема бойынша AI Router да жұмыс істейді: қосымша бір OpenAI-ге үйлесімді эндпоинтті көреді, ал маршрутизация, шығын есебі және шектеулер бір жерде жинақталған.

SDK-ны қайта жазбай схеманы қалай жинауға болады

Мультипровайдерлік схема тек қолданба бірдей сұраныс контрактын көргенде ғана тыныш жұмыс істейді. Егер бүгін бір сервис OpenAI Chat Completions жіберіп, екіншісі басқа провайдермен өз форматында сөйлессе, резервтеу тез арада «жамау» жиынына айналады.

Бір ішкі контракттан бастаңыз. Іс жүзінде OpenAI-ге үйлесімді формат ең қолайлы: сұраныс өрістері бірдей, жауап схемасы бірдей, қате өңдеу бірдей. Сонда команда жаңа провайдерге клиентті қайта жазбайды және модель ауысқан сайын парсерді жөндеп отырмайды.

Содан кейін реттілік қарапайым:

- Барлық сервистер үшін бір эндпоинт және бір сұраныс форматын таңдаңыз. Қолданба тек осы интерфейсті білуі керек.

base_urlмен API-токенді кодтан конфигке немесе environment айнымалыларына шығарыңыз. Сонда маршрутты релизсіз өзгерте аласыз.- Провайдерлердің алдына маршрутизация қабатын қойыңыз. Ол сұранысты қайда жіберетінін модель, баға, кідіріс, деректерді сақтау талабы немесе қолжетімділік бойынша шешеді.

- Қысқа timeout және түсінікті retry ережелерін орнатыңыз. Бір провайдердің ілініп қалуы пайдаланушы сұранысын 30 секунд ұстап тұрмауы тиіс.

- SDK, промпттар және жауапты талдау өзгермейтін тест жүргізіңіз. Егер клиент кодын өзгертуге тура келсе, схема әлі дайын емес.

Жақсы ереже былай дейді: қолданба провайдерді тікелей таңдамайды. Оны шлюз таңдайды. Қолданбаның өзі бірдей сұраныс жібереді және бірдей типтегі жауап алады. Егер негізгі провайдер 2–3 секунд ішінде жауап бермесе, шлюз алдын ала анықталған ереже бойынша трафикті запас маршрутқа аударады.

Сондықтан base_url-ды бір жерде ғана сақтау жақсы. Команда үшін бұл ұсақ нәрсе сияқты, бірақ ол көп уақыт үнемдейді. Егер компания қазірдің өзінде OpenAI SDK қолданса, оған көбіне API адресі мен токенін AI Router сияқты OpenAI-ге үйлесімді шлюздің api.airouter.kz эндпоинтіне ауыстыру жеткілікті болады, ал шақырулар мен промпттар сол күйі қалады.

Мұны шағын сценарийде тексеріңіз: бір чат-сұраныс, бір SDK және шлюздің артында екі провайдер. Егер жауаптар бір схемаға келсе, timeout болжамды жұмыс істесе, ал қолданба маршрут ауысуын байқамаса, негіз дұрыс жиналған.

Ортақ аутентификацияны қалай ұйымдастыру керек

Көппровайдермен жұмыс істегенде қолданба әр провайдердің құпияларын білуге тиіс емес. Оған бір ішкі кілт немесе service token керек, сонымен тек сіздің шлюзіңізге қатынайды. Одан әрі шлюз OpenAI, Anthropic, Google немесе басқа модель үшін қай сыртқы кілтті алу керегін өзі шешеді.

Бұл қолдауды айтарлықтай жеңілдетеді. Әзірлеушілер кодта әртүрлі токен, header және жаңарту ережелерінің орнына бір ғана авторизация схемасын ұстайды. Ертең провайдерді ауыстырсаңыз не қосалқы маршрут қоссanız, қолданбаға тимейсіз.

Сыртқы құпияларды кодтан бөлек сақтаңыз. Secret manager, KMS немесе кем дегенде рөлдер бойынша қолжетімділігі бар қорғалған environment сақтау орны жарайды. Құпиялар репозиторийде, CI-логтарда және ойланбай барлық серверге кететін конфигте тұрмауы керек.

Қолжетімділікті орта және команда бойынша бөліңіз. Production, staging және dev үшін бөлек ішкі кілттер мен лимиттер болғаны дұрыс. Егер аналитика командасы промпттарды тексеріп жатса, оларға клиенттерге prod-та жауап беретін сервистегімен бірдей қолжетімділік керек емес.

Тәжірибелік схема былай көрінеді: сервис бір ішкі API кілтін алады, шлюз сонымен сұраныс жіберушіні анықтайды, қажет провайдердің сыртқы құпиясын қояды, ал лимиттер мен құқықтарды ішкі кілт деңгейінде орнатады. Провайдерлердің өз кілттері қолданбадан тыс жерде сақталады.

Құпияларды ротациялау да кодқа түзетусіз өтуі керек. Сіз сақтаудағы құпияны ауыстырасыз, шлюз жаңа нұсқаны тартып алады, ал сервис сол бір бірыңғай эндпоинтке сұраныс жібере береді. Бұл әсіресе провайдер инциденттен кейін кілтті шұғыл қайта шығаруды сұрағанда немесе трафиктің бір бөлігін басқа аккаунтқа көшіру керек болғанда ыңғайлы.

Аудит-логтарды үнемдеуге болмайды. Лог төрт сұраққа жауап беруі керек: сұранысты кім жіберді, қайда кетті, қандай ішкі кілт қолданылды және бәрі немен аяқталды. AI Router-да бұл тәсіл кілт деңгейінде already қолдау табады: аудит-логтар мен rate limits бар, сондықтан банкке, SaaS-командаға немесе ішкі платформаға бірнеше вендордың бөлек кабинеттерінен картинаны құрастырудың керегі жоқ.

Резервтеуді қалай күтпеген жерден бұзбай баптауға болады

Резервтеу ақау кезінде емес, одан бұрын бұзылады: команда кез келген қатені бірден басқа провайдерге өтудің себебі деп есептегенде. Бұлай жасауға болмайды. Әр маршрут үшін түсінікті тәртіп болуы керек: негізгі провайдер және запас нұсқа. Егер чат екі провайдерде бір модельмен жұмыс істесе, мұны алдын ала бекітіп, себепсіз жолды лезде өзгертпеңіз.

Алдымен қателерді түрге бөліңіз. Жалпы HTTP status өзі көп нәрсені айтпайды. 429 әдетте жүктеменің артуын немесе лимитті білдіреді, timeout желі не кідіріс туралы айтады, 5xx провайдердегі ақауды көрсетеді. Ал 401, 403, сұраныс формасындағы қате немесе policy бойынша бұғаттау запас маршрутты іске қоспауы тиіс. Егер сұраныстың өзі қате болса, екінші провайдер де көбіне сол проблеманы қайтарады.

Көп жағдайда қарапайым ережелер жеткілікті:

- timeout шектен асса — бір рет қайта көріңіз, содан кейін запас маршрутқа өтіңіз

429және5xx— запас маршрутқа жылдам өтіңіз- аутентификация, policy және валидация қателері — ауыстырмай, клиентке түсінікті қате қайтарыңыз

- бос немесе бұзылған жауап — провайдер ақауы деп санап, запас маршрутты қосыңыз

Ауыстырғаннан кейін клиент жауап басқа жерден келгенін сезбеуі тиіс. Ол үшін шлюз жауаптарды бір схемаға келтіреді: өрістер бірдей, usage форматы ортақ, қате құрылымы бір, role мен message атаулары да сол күйі қалады. Әйтпесе ескі SDK формалды түрде жұмыс істегенімен, қолданба парсингте, токен санауда немесе tool calls өңдеуде бұзыла бастайды.

Уақыт бойынша да шекті орнатқан пайдалы. Егер негізгі провайдер 2 секундта жауап берсе, ал запас нұсқа 12 секунд алса, соқыр ауысу өнімді қысқа кідірістен де нашарлатуы мүмкін. Тәжірибеде жиі жұмыс істейтіні — екі рет қатарынан ақау болғанда немесе кідіріс сіздің нормаңыздан айқын асқанда ғана ауысу.

Сосын схеманы жүктемеде тексеріңіз. Провайдерді өшіріп, бір қолмен сұрау жіберу жеткіліксіз. Бір бөлік сұраныс timeout алатын, бір бөлігі 429 алатын, бір бөлігі бұзылған JSON қайтарылатын тест керек. Егер осы кезде қолданба бірдей жауап форматын алып, сессияны жоғалтпаса, резервтеу дұрыс бапталған.

Екі провайдері бар support чаттың мысалы

Support чат қолданбаның өзі бір ғана эндпоинтті білетіндей етіп құрылғаны ыңғайлы. Веб-чат, мобильді қосымша және CRM сұраныстарды бір нүктеге жібереді, ал ары қарай шлюз модель мен провайдерді қарапайым ережелермен өзі таңдайды. Команда үшін бұл — бірқатар бөлек интеграцияның орнына бір API деген қалыпты көппровайдерлік қолжетімділік.

Мысалы, жеткізу сервисін алайық. Сұраныстардың көбі қызықсыз, бірақ көп: тапсырыс статусы, уақытты ауыстыру, қайтару, адрес өзгерту. Мұндай сұрақтарды қымбат модельге жіберудің қажеті жоқ. Оларды бірінші провайдердің жылдам моделі өңдейді, ол 1–2 секундта жауап беріп, әдеттегі ағын үшін бағаны төмен ұстайды.

Егер клиент әдеттегіден ұзақ жазса, даулы жағдайды талдауды сұраса немесе бірінші провайдер баяулай бастаса, сұраныс екіншіге өтеді. Қолданба оны байқамайды. Ол бәрібір сол OpenAI-ге үйлесімді эндпоинтке жүгінеді, ал резервтеу логикасы шлюздің ішінде өмір сүреді.

Маршрут әдетте болжамды көрінеді: қысқа FAQ және статус сұрақтары жылдам модельге кетеді, timeout пен 5xx сұранысты бірден запас провайдерге аударады, ал акция кезіндегі жүктеме пигтері ішінара екінші арнаға жіберіледі. Егер хабарламада ИИН, телефон, адрес немесе келісімшарт нөмірі болса, мұндай мәтінді өз контурыңыздағы жергілікті модельге жіберген жөн.

Соңғы тармақ көбіне ойлағаннан көп мәселе шешеді. Оператор клиент деректерін тексеруді сұрағанда, мұндай мәтінді сыртқы сервиске себепсіз шығармаған дұрыс. Егер компанияға Қазақстан аумағында data residency керек болса, сезімтал сұраныстарды ел ішінде ұстаған орынды. AI Router-да бұл үшін өз GPU инфрақұрылымындағы 20+ open-weight модель бар, оларды сол бір OpenAI-ге үйлесімді API арқылы қолдануға болады.

Іске қосылғаннан кейін support командасы мен инженерлер болжамға емес, фактіге қарайды. Әр сұраныс бойынша журналда қай провайдер жауап бергені, қай модель жұмыс істегені, жауап қанша уақыт алғаны және құны қанша болғаны көрінеді. Бір аптадан кейін қарапайым нәрсе айқын болады: типтік сұрақтарды жылдам әрі арзан модельде ұстауға болады, ал запас провайдер әр сұраныс үшін емес, тек ақау мен жүктеме кезінде керек.

Схеманы жиі бұзатын қателер

Көппровайдерлік схема көбіне модельдердің өзінен емес, маршруттау кезіндегі ұсақ шешімдерден бұзылады. Сырттан қарағанда бәрі қарапайым: бір эндпоинт, бір SDK, бір токен. Іс жүзінде ақау көбіне ауыстыру ережелерінде, қолжетімділік құқықтарында және логтарда жасырынады.

Жиі кездесетін бірінші қате — кез келген 429-дан кейін провайдерді ауыстыру. Мұндай жауап әрдайым провайдер қолжетімсіз дегенді білдірмейді. Кейде сіз нақты кілт, модель немесе сұраныс түрі бойынша лимитке тірелесіз. Трафикті ойланбай әрі қарай жібере берсеңіз, жүйе провайдерлер арасында ырғалып, кідіріс өседі. Лимит қай жерде, квота қай жерде таусылды, ал қай жерде провайдердің өзі шынымен бұзылды — соны бөлек ажыратқан дұрыс.

Екінші қате — әр команданың қолжетімділігін бір токенге байлау. Онда support-бот, ішкі copilot және тест стенді бір лимит пен бір тарихты бөліседі. Сосын бір команда 429 алады да, кінә басқасына ұқсап көрінеді. Қалыпты схема әлдеқайда қарапайым: жеке кілттер, жеке лимиттер, жеке логтар.

Модельдерді тек атауына қарап салыстыру да көп мәселе тудырады. Бір атаудағы модель әр провайдерде нұсқа, контекст ұзындығы, stream жауап сапасы, tool calls қолдауы және тіпті қате форматы бойынша өзгеше болуы мүмкін. Егер тек қысқа мәтіндік сұранысты сынасаңыз, схема жұмыс істеп тұрғандай көрінеді. Продакшнда бірінші болып функциясы бар немесе ұзақ диалог бар сценарий бұзылады.

Тексеруге тұрарлық минимум — қарапайым жауап, stream арқылы жауап, нақты схема қолданатын tool calls және сіздің типтік контекстіңіз бар ұзақ сұраныс. Осысының өзі релизге дейін жағымсыз айырмашылықтардың көп бөлігін ұстап қалады.

Тағы бір қате сырттай өте жай көрінеді, бірақ басқалардан қатты соғады: логқа сұраныстың нақты маршруты жазылмайды. Сосын сұранысты қай провайдер өңдегенін, неге fallback іске қосылғанын, жауап қанша уақыт алғанын және құн қай жерде өскенін ешкім айта алмайды. Логта кемінде провайдер, модель, маршрут таңдаудың себебі, жауап коды және кідіріс болуы керек. Онсыз резервтеу жорамалға айналады.

Іске қосар алдындағы тексеріс

Прод алдында жайсыз емес, зеріктіретін ақауларды ертерек ұстаған дұрыс. Көппровайдерлік схема үшін бұл әдетте бір үлкен қате емес, бірнеше майда нәрсе: stage-та басқа эндпоинт, бұзылған stream, ауысу кезінде артық кідіріс немесе түсініксіз шығын.

Егер сізде OpenAI-ге үйлесімді шлюз болса, барлық орта үшін бір сұраныс форматын ұстау ыңғайлы. Өзгеруі тиіс нәрсе — құпиялар, лимиттер және қолжетімді модельдер жиыны; ал клиент коды мен әр сервистегі base_url өзгермеуі керек.

Жылдам тексеріс шамамен 15 минут алады. Бірдей сұранысты dev, stage және prod арқылы өткізіңіз. Тек жауап мәтінін емес, header, timeout және қате кодтарын да салыстырыңыз. Бөлек түрде үш режимді тексеріңіз: кәдімгі жауап, stream және tools шақыруы. Көбіне базалық чат дұрыс жұмыс істейді, ал stream проксида үзіледі немесе tools аргумент схемасын жоғалтады.

Одан кейін провайдердің істен шығуын имитациялап, ауысу уақытын өлшеңіз. Егер пайдаланушы сұранысына сіздің шегіңіз 3 секунд болса, резервке өту осы бюджеттің көбін жеп қоймауы тиіс. Сосын логтарды ашып, онда модель, провайдер, орта, сұраныс маршруты және соңғы статус көрінетініне көз жеткізіңіз. Әйтпесе инцидентті талдау тағы да жорамалға айналады.

Соңында шығын есебін қараңыз. Онда сервис, команда және орта бөлек көрсетілуі керек, сонда тест трафигі боевой трафикпен араласпайды. Егер сіз сыртқы провайдерлерді де, жергілікті модельдерді де қолдансаңыз, екі нұсқаны бір billing пен бір маршрут тарихында көру пайдалы.

Жақсы қысқа тест қарапайым көрінеді. Бір сервис 20–30 бірдей сұраныс жібереді, содан кейін сіз негізгі провайдерді қолмен өшіріп, не өзгеретінін бақылайсыз: жауап уақыты, дерек форматы, қате үлесі және құны. Пайдаланушыға қай провайдер жауап бергені маңызды емес. Оған чат ілінбей жұмыс істегені, stream үзілмегені және tool қайта шақырылмағаны маңызды.

Әрі қарай не істеу керек

Барлық LLM сценарийін бірден жаңа схемаға көшірмеңіз. Жүктемесі түсінікті бір сервисті алыңыз, мысалы support чат, және оған бір эндпоинт арқылы екі провайдерді қосыңыз. Сонда команда timeout, лимит және жауап форматы қай жерде бұзылатынын тез көреді.

Трафикті бөлуге дейін базалық картинаны түсіріп алыңыз. Орташа кідіріс пен p95-ті өлшеңіз, нақты профиль бойынша бір сұраныстың бағасын және 1000 токеннің бағасын есептеңіз, қате үлесін түрі бойынша сақтаңыз және қай сұраныстарға деректерді қатаң сақтау керек, ал қайсысын сыртқы контурға жіберуге болатынын бөлек белгілеңіз. Бұл деректерді кемінде бірнеше күн жинаған дұрыс. Әйтпесе кейін жағдай жақсарды ма, әлде жүктеме профилі ғана өзгерді ме — түсіну қиын болады.

Бір аптадан кейін екі нәрсені салыстырыңыз: пайдаланушы қай жерде ұзақ күтеді және сіз қай жерде сол бір тапсырма үшін көбірек төлейсіз. Егер бір модель сәл жақсырақ жазса, бірақ екі есе баяу жауап берсе, бұл инженерлердің талғамына ғана емес, өнімге де әсер етеді.

Деректер мен журналдар ережесін бөлек тексеріңіз. Промпттар мен жауаптар қайда сақталады, аудит-логтарды кім көреді, PII қалай маска жасалады, логтарды қанша уақыт ұстайсыз және әр сценарий үшін сыртқы хостингті қолдануға бола ма — осыны анықтаңыз. Банк, телеком, ритейл немесе мемлекеттік сектор үшін бұл көбіне модель бағасынан да қатты архитектураға әсер етеді.

Егер сіз Қазақстанда жұмыс істесеңіз, жергілікті талаптарды already жауып тұрған шлюзді алған ыңғайлы. AI Router-дың airouter.kz-та бір OpenAI-ге үйлесімді API-ы, сыртқы провайдерлер арасындағы маршрутизациясы және 20+ жергілікті open-weight моделі бар, деректерді ел ішінде сақтау, PII masking, аудит-логтар және кілт деңгейіндегі rate limits бар. B2B командалар үшін бұл есеп айырысуды да жеңілдетеді: инвойсинг ай сайын теңгемен, API үстемақысынсыз жүреді.

Әрі қарай тәртіп қарапайым: алдымен жаңа қабат арқылы трафиктің 5%-ын өткізіңіз, содан кейін бір тапсырма класын толық көшіріңіз, тек содан кейін үшінші провайдерді немесе күрделірек маршрут ережелерін қосыңыз. Тәсіл зеріккендей көрінеді, бірақ әдетте дәл сол тәсіл апталарға созылатын debugging пен артық шоттарды үнемдейді.

Жиі қойылатын сұрақтар

Егер бізде OpenAI SDK already болса, кодты қайта жазу керек пе?

Әдетте жоқ. Егер шлюз OpenAI-ге үйлесімді форматты қолдаса, көбіне тек base_url мен токенді ауыстырасыз, ал SDK шақырулары мен промпттар сол күйі қалады.

Кейін stream, tools және қателерді өңдеуді тексеріңіз. Айырмашылықтар көбіне дәл сол жерде байқалады.

Бірыңғай шлюзге көшкенде интеграцияда не шын мәнінде өзгереді?

Сервис бір ғана API мекенжайын және бір ішкі токенді білуі керек. base_url мен құпияларды конфигке шығарып, провайдерді таңдауды шлюзге беріңіз.

Сонда маршрутты релизсіз өзгерте аласыз және бірнеше репозиторийге қол тигізбейсіз.

Барлық провайдерлер үшін ортақ API форматы ретінде нені таңдаған дұрыс?

Барлық сервистер үшін бір ішкі контракт алыңыз. Ең ыңғайлысы — OpenAI-ге үйлесімді схема, өйткені оған үйреншікті SDK-лар мен түсінікті жауап форматы бар.

Одан кейін сұраныс өрістері, қате құрылымы және бірдей usage сақталсын. Әйтпесе резервтеу парсинг кезінде тез бұзылады.

Қайталанатын сұраныстарды көбейтпей резервтеуді қалай баптауға болады?

Бір қысқа timeout, желілік қате үшін бір рет қайталау және 429 пен кейбір 5xx үшін запас маршрутқа жылдам өту жеткілікті. Tools шақырулары үшін қайта іске қосылудан қорғау қосыңыз, әйтпесе әрекет екі рет орындалуы мүмкін.

Қарапайым ереже мынау: клиент бір ғана сұраныс жібереді, ал шлюз қашан және қайда ауысатынын өзі шешеді.

Қандай жағдайда бірден қосалқы провайдерге өтпеу керек?

401, 403, валидация қатесі және policy-блок кезінде маршрутты ауыстырмаңыз. Егер сұраныстың өзі дұрыс болмаса немесе қолжетімділік бұзылса, екінші провайдер көбіне сол мәселені қайтарады.

Резерв timeout, 429, кейбір 5xx және провайдер жағындағы бұзылған жауап кезінде керек.

Провайдер токендерін қалай дұрыс сақтау және ауыстыру керек?

Қолданбада тек шлюзге кіруге арналған ішкі кілт болуы керек. Провайдерлердің сыртқы құпияларын secret manager не басқа қорғалған сақтауда сақтап, кодқа да, CI-логтарға да қоспаңыз.

Ротацияны да шлюз жағында жасаңыз. Сонда сервис ешқандай түзетусіз әрі жаңа релизсіз жұмысын жалғастырады.

Prod, тест және әртүрлі командалар арасындағы қолжетімділікті қалай бөлуге болады?

Кілттерді орта мен сервис бойынша бөліңіз. Prod, stage және dev үшін лимиттер мен журналдар бөлек болғаны дұрыс, сонда тест трафигі боевой ортаға араласпайды.

Дәл осындай тәсіл командаларға да керек. Support чаты, ішкі copilot және аналитиктердің тәжірибелері бір ортақ токенді бөліспеуі тиіс.

Ақау себебін және шығын өсуін кейін түсіну үшін қандай логтар қажет?

Журналға сұранысты кім жіберді, шлюз қандай маршрутты таңдады, қай провайдер мен модель жауап берді, жауап қанша уақыт алды және немен аяқталды — осыны жазыңыз. Көптеген ақауларды талдауға осының өзі жетеді.

Егер оған қоса токендер мен құнды қоссаңыз, команда баға қай жерде өсіп жатқанын және қай маршрут баяулап тұрғанын тез көреді.

Қай кезде сұраныстарды сыртқы сервиске емес, жергілікті модельге жіберген дұрыс?

Мәтінде құпия деректер болса немесе ереже бойынша деректерді ел ішінде сақтау керек болса, локальды модель керек. Support чатында бұл көбіне ЖСН, телефон, мекенжай, келісімшарт нөмірі сияқты өрістер болады.

Мұндай схемада ортақ шлюз әсіресе ыңғайлы: қолданба сол бір сұранысты жібереді, ал шлюз сезімтал трафикті ішкі контурға өзі бағыттайды.

Барлық prod-ты бірден қатерге тігім келмесе, неден бастау керек?

Жеңіл және тәуекелі аз сценарийден бастаған дұрыс, мысалы support чатынан. Трафиктің аз бөлігін шлюз арқылы өткізіп, кідіріс, қате және бағаны салыстырыңыз, содан кейін схеманы кеңейтіңіз.

Егер Қазақстанға дайын қабат керек болса, AI Router қазірдің өзінде бір үйлесімді API, маршрутизация, аудит-логтар, PII masking және SDK-ны ауыстырмай-ақ жергілікті модельдер береді.